TL;DR

Na Invent, oferecemos follow-ups automáticos com IA no WhatsApp para engajar clientes fora do expediente, em fins de semana e feriados. Quando os clientes estão indisponíveis, nossa IA identifica o momento ideal para retomar o contato, mantendo as conversas ativas e os negócios avançando e sendo fechados sem intervenção manual.

Mas operar IA nesse nível de autonomia levanta uma questão crítica: como sabemos, de fato, que ela está funcionando conforme o esperado?

É aí que observabilidade de IA entra em cena e é fundamentalmente diferente do que a maioria das equipes espera.

Observabilidade de IA = a capacidade de rastrear, reproduzir e avaliar cada decisão da IA em produção — do prompt e uso de ferramentas aos handoffs e resultados.

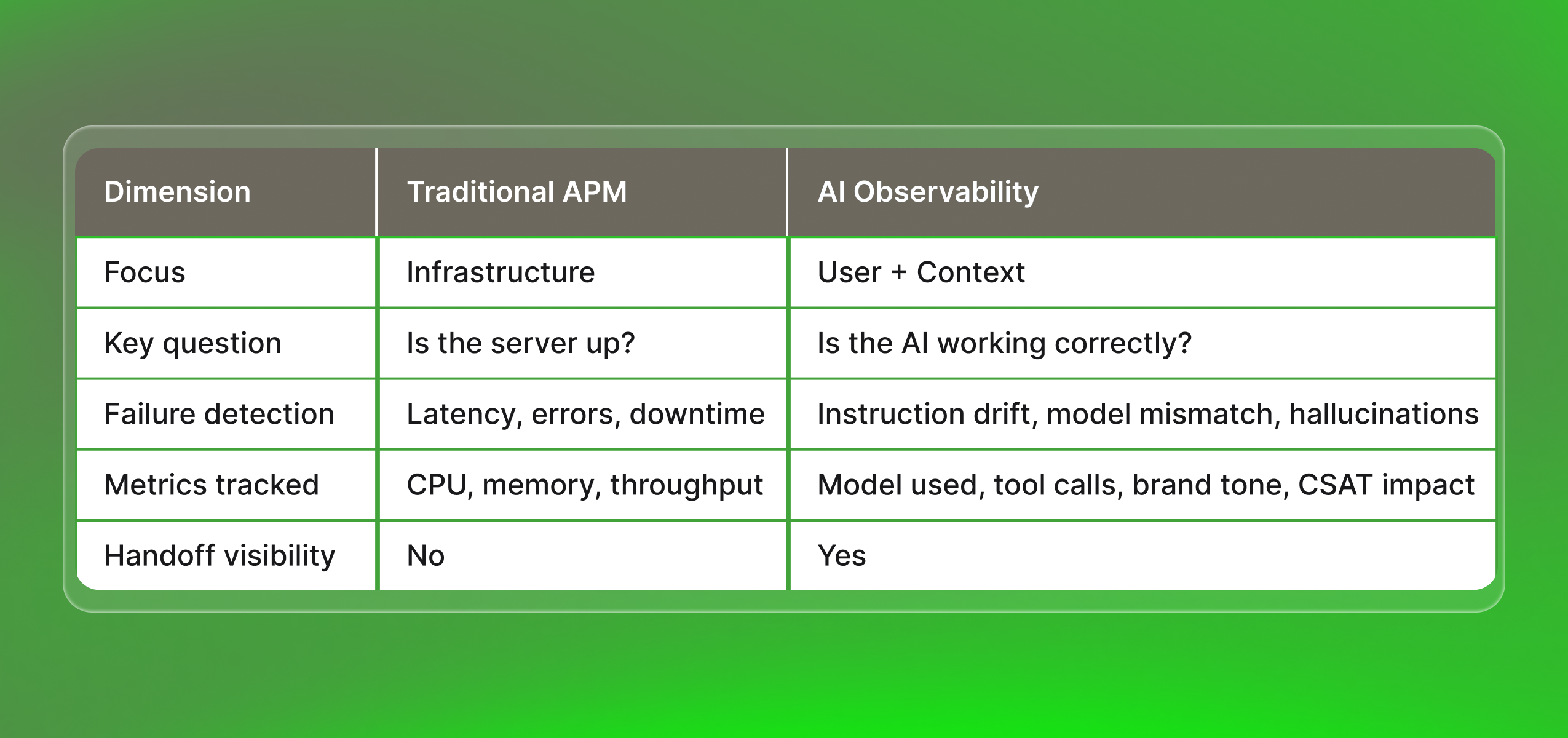

Por que o APM tradicional não é suficiente para IA

O Application Performance Monitoring (APM) tradicional acompanha a saúde da infraestrutura: latência, erros, throughput e uso de recursos entre serviços e bancos de dados. Ele nos diz se o sistema está em execução.

A observabilidade de IA faz um conjunto mais profundo de perguntas:

- O assistente está seguindo suas instruções de sistema?

- Ele está mantendo o tom de marca no WhatsApp, web, SMS e e-mail?

- Ele está usando corretamente as ferramentas (Stripe, Odoo, CRM, calendário, busca)?

- Ele permanece alinhado ao que o usuário realmente está tentando realizar?

É intrinsecamente centrada no usuário e no contexto. O que importa é se a IA:

- Encaminhou um lead corretamente

- Resolveu um ticket de suporte

- Respeitou as regras de memória e privacidade

- Coordenou um handoff fluido para um humano

Tudo isso pode falhar silenciosamente, mesmo quando todas as métricas de infraestrutura estão verdes.

Em configurações multimodelo, baseadas em agentes (GPT, Claude, Gemini, Grok + ferramentas em tempo real), a observabilidade também deve capturar:

- Qual modelo foi selecionado

- Quais ferramentas foram executadas

- Como essas escolhas afetaram custo, qualidade e CSAT

Da infraestrutura à inteligência: veja como a Observabilidade de IA redefine o monitoramento, focando no contexto do usuário, no comportamento do modelo e nos resultados do mundo real até o handoff.

As formas mais comuns de falha em sistemas de IA

A falha mais frequente que encontramos não é alucinação nem indisponibilidade, é desalinhamento modelo–tarefa. Equipes sem ampla experiência entre modelos costumam recorrer às opções mais familiares, e os resultados podem ser sutis, porém caros.

Grok 4.1 vazou seu raciocínio interno

O Grok 4.1 expôs suas etapas de raciocínio interno diretamente para os usuários finais. Isso não foi uma alucinação; foi um descompasso comportamental entre os padrões do modelo e os requisitos do produto. Sem observabilidade, essa falha se esconde à vista de todos.

Gemini Flash 2.5 alucina diante de lacunas de conhecimento

O Gemini Flash 2.5 tende a alucinar quando as informações necessárias não estão na sua base de conhecimento (instruções ou system prompt). Quando falta contexto, o modelo preenche a lacuna. A correção nem sempre é trocar de modelo; é enriquecer a arquitetura de conhecimento.

Alucinações podem decorrer de falta de conhecimento ou de um problema do modelo.

Escolhendo o tamanho de modelo certo

- Modelos pequenos (versões Nano, Lite e Mini): Eficientes para tarefas no estilo FAQ sem escalonamento.

- Modelos grandes (Opus, Sonnet, Gemini Pro e a série Flash, série GPT): Necessários para raciocínio complexo e em múltiplas etapas.

A observabilidade nos mostra, ao longo do tempo, se a calibração do modelo está realmente se mantendo.

O teste real: você consegue reproduzir uma jornada de IA que falhou?

Ao avaliar plataformas de observabilidade para LLMs, pipelines de RAG ou sistemas baseados em agentes, usamos um único critério:

Conseguimos reproduzir integralmente uma jornada de IA que falhou?

Exemplo prático: Em um chatbot de RAG apoiado pelo seu site e pelo Stripe, uma jornada de pagamento com falha deve ser reconstruível de ponta a ponta:

- Mensagens exatas do usuário

- Quais páginas foram recuperadas

- Quais chamadas da API do Stripe foram acionadas

- Como o modelo interpretou o erro

- Como o handoff para humano se desenrolou na caixa de entrada

Se suas ferramentas não conseguem fornecer isso, você tem logs — não observabilidade.

Na Invent, nós construímos observabilidade por canal e a estendemos por todos os pontos de integração. Ter capacidade de reprodução e continuidade de contexto em toda a jornada assistida por IA é crucial.

O que acontece quando você voa às cegas

Vimos o padrão se repetir em ambientes de clientes: ferramentas fragmentadas, visibilidade limitada, comportamento de IA em caixa-preta. Em todos os casos, as falhas eram mensuráveis — e evitáveis.

O cenário mais prejudicial? Baixa visibilidade dos handoffs entre IA e humanos. Quando ninguém consegue ver exatamente onde a IA parou e um humano deveria ter assumido:

- As transições ficam desajeitadas

- Tickets são perdidos

- As pontuações de CSAT caem

A jornada se quebra, mas como nenhuma ferramenta captura o quadro completo, o diagnóstico nunca acontece.

Isso não é uma falha técnica. É uma falha de observabilidade.

UX e desenvolvimento de produto precisam ser integrados. A observabilidade torna isso real.

Checklist de prontidão para produção

Antes de colocar IA em produção, recomendamos fazer estas 7 perguntas:

- Conseguimos reproduzir de ponta a ponta qualquer jornada de IA que falhou?

- Sabemos qual modelo foi usado em cada decisão?

- Conseguimos rastrear cada chamada de ferramenta (CRM, pagamentos, calendário, busca)?

- A consistência do tom de marca é monitorada em todos os canais?

- Os handoffs entre IA e humanos são visíveis e auditáveis?

- Temos alertas em tempo real para deriva de instruções ou alucinações?

- Conseguimos correlacionar o comportamento da IA com CSAT, conversão e custo?

Se você respondeu “não” a qualquer uma delas, você não está pronto para produção.

Perguntas frequentes

1. Como as empresas devem escolher ferramentas de observabilidade de IA?

Priorize compliance (SOC2, trilhas de auditoria), escala (bilhões de traces), cobertura híbrida (ML + LLMs + agents) e compatibilidade com o ecossistema.

2. Modelos de precificação de serviços populares de observabilidade de IA?

- Baseado em uso: Por trace/previsão/token (Phoenix, LangSmith)

- Baseado em host/entidade: Por unidade de infraestrutura (Datadog, New Relic)

- Usuários + uso: Por usuário + volume de dados

- Empresarial: Contratos customizados com limites

3. Plataformas de observabilidade de IA para empresas?

Cloudflare AI Gateway (observabilidade de prompt), Arize Phoenix (deriva), LangSmith (debug de LLM).

Construindo uma cultura em torno da observabilidade

Obtemos nossos melhores resultados combinando habilidade técnica profunda com transparência radical e colaboração assíncrona. Transformar PRs entre fusos horários e o compartilhamento aberto de contexto em hábitos diários nos permitiu acelerar entregas, aumentar a agilidade do time — e esse impulso só se mantém quando a observabilidade é incorporada como uma capacidade central do produto.

Na Invent, compartilhamos insights de como construir plataformas de engajamento do cliente com IA que operam de forma confiável em WhatsApp, web, SMS e e-mail. Explore mais em useinvent.com.