TL;DR

Se hai mai messo in produzione un chatbot AI e hai scoperto che i costi reali erano superiori alla stima, hai già capito qualcosa di importante: l'uso dell'AI è più dinamico di quanto qualunque calcolatore possa catturare in anticipo. Non è un problema, è semplicemente la natura delle conversazioni reali. Capire perché i costi variano è il primo passo per riuscire davvero a controllarli.

"La cosa più costosa nell'AI non è il modello. Sono i token che non ti accorgi di inviare."

G.H.

1. Cosa azzeccano gli strumenti di stima (e dove si fermano)

I calcolatori dei costi chiedono: messaggi giornalieri e modello AI. Moltiplicano un costo fisso per messaggio per il volume.

Esempio:

100 messaggi/giorno × 30 giorni × $0,0025/messaggio ≈ $7,50/mese

È una base intelligente e un ottimo modo per confrontare i modelli o stimare l'ROI prima di andare in produzione. Quello che non può prevedere in anticipo è come si comporteranno le conversazioni reali: quanto durano, quali funzionalità sono attive o se avrai picchi di traffico. Non è un difetto del calcolatore. È semplicemente la differenza tra una stima e un ambiente live.

2. Come il contesto guida i costi

L'AI non legge solo il tuo ultimo messaggio. Legge tutto, ogni volta.

Ogni risposta include:

- Prompt di sistema (istruzioni)

- Contenuti della base di conoscenza / delle FAQ

- Intera cronologia della conversazione

- Nuovo messaggio dell'utente

Questa finestra di contesto cresce in fretta. Il messaggio 1 costa poco. Il messaggio 30 costa 30–50 volte di più perché l'intera cronologia viene rieseguita ogni volta.

Esempio reale: Una risposta ha utilizzato 22.696 token di input (contro 564 di output). La stima prevedeva ~500 di input. In realtà: 45x in più.

Modello mentale: Aggiungere una pagina a un documento, ma ristampare l'intero documento ogni volta.

3. Cinque fattori chiave di costo

- Cronologia della conversazione, inviata ogni volta. Chat da 30 messaggi costano oltre 100 volte una singola interazione.

- Prompt di sistema, ovvero istruzioni, sempre inclusi. 3.000 token gonfi vs 300 snelli = 10x di differenza per chiamata.

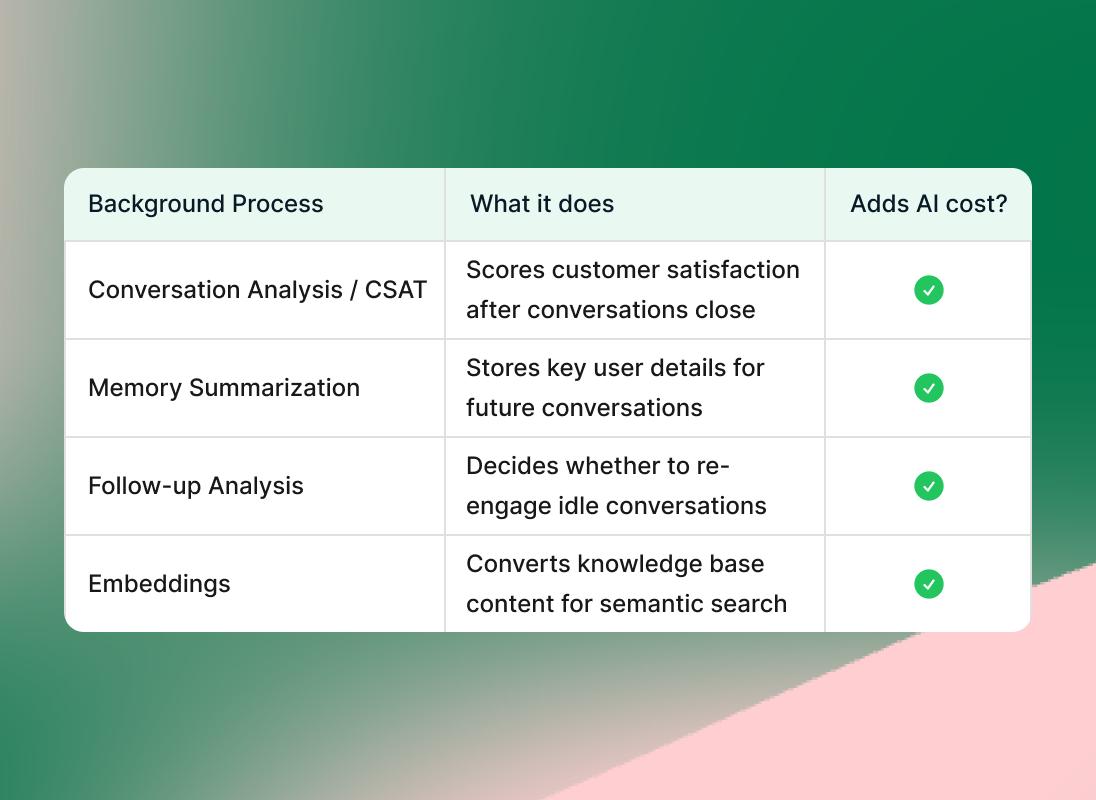

- Processi in background, CSAT, sintesi della memoria, follow-up, embeddings. Spesso 3–5 chiamate AI per messaggio.

- Messaggi multimediali: note vocali, PDF, immagini consumano migliaia di token ciascuno.

- Picchi di traffico, campagne virali generano giornate con volumi 10x che la stima non poteva prevedere.

I processi in background si sommano: le moderne piattaforme di assistenti AI eseguono più attività dietro le quinte, come analisi della conversazione, follow-up e sintesi della memoria, che contribuiscono ciascuna ai tuoi costi AI.

4. Principi di context engineering

Modelli più economici aiutano. Ma context engineering, modellare deliberatamente ciò che entra nella finestra di contesto, offre i risultati maggiori. I token di input dominano i costi, e l'input è sotto il tuo controllo.

Pilastro 1: Prompt di sistema snelli, inviati a ogni chiamata, per sempre.

- Definisci il ruolo in 2–3 frasi (non 20)

- Usa elenchi puntati, non paragrafi

- Elimina i duplicati ("sii sempre cortese" una volta basta)

- Elimina i casi limite rari

Obiettivo: <500 token per i semplici; <1.500 per i complessi

Pilastro 2: Smart Knowledge Retrieval (RAG)

Buttare tutte le FAQ in ogni chiamata è l'approccio ingenuo. RAG recupera solo le sezioni pertinenti per ogni domanda specifica.

Ecco come funziona:

- L'utente fa una domanda

- Il sistema cerca nelle FAQ (o nella base di conoscenza) i pezzi più rilevanti

- Solo quelle sezioni specifiche e pertinenti vengono inviate all'AI

- L'AI risponde usando solo ciò che serve

Ecco un esempio di come puoi inserire le istruzioni:

[ISTRUZIONI]

Sei un assistente condominiale disponibile. Usa le informazioni qui sotto per rispondere.

Conoscenze rilevanti:

- Orari piscina: lunedì–domenica, 8:00–22:00.

- La piscina è chiusa durante le festività e i giorni di manutenzione.

Domanda del residente: "Quali sono gli orari della piscina?"

Pilastro 3: Gestione della cronologia della conversazione

- Finestra scorrevole: solo gli ultimi 8–10 messaggi

- Sintesi: comprimi la cronologia passata in fatti chiave

- Memoria selettiva: conserva solo il contesto significativo

- Reset della sessione: riparti da zero dopo la risoluzione

5. La tua checklist operativa

- Fai l’audit del prompt di sistema, dimezzalo. Verifica la qualità. Di solito rimarrai sorpreso.

- Recupera, non iniettare. Usa la ricerca semantica solo per le conoscenze pertinenti.

- Metti un limite alla cronologia: gli ultimi 8–10 turni bastano quasi sempre.

- Disabilita le funzionalità inutilizzate. Disattiva CSAT/memoria se non usi quei dati.

- Abbina il modello al compito. Economico/veloce per Q&A; premium solo per il ragionamento.

- Progetta per meno turni. Risposte rapide e flussi strutturati riducono turni e costo.

- Regola i media: abilita l’elaborazione di voce/immagini/documenti solo quando serve.

- Monitora per evento. Tieni traccia settimanalmente di token, processi in background e media.

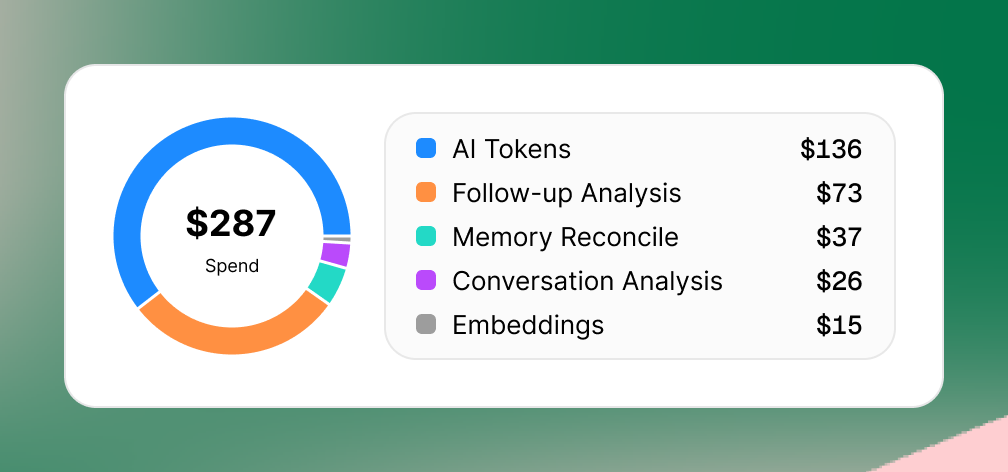

Widget di dashboard che mostra una spesa AI di $287 visualizzata da un grafico a ciambella colorato. Una legenda elenca le categorie di costo AI: AI Tokens ($136, blue), Follow-up Analysis ($73, orange), Memory Reconcile ($37, teal), Conversation Analysis ($26, purple) ed Embeddings ($15, gray), su uno sfondo a gradiente verde e rosa.

Domande frequenti

1. Come riduco l’uso di token nel mio chatbot AI senza peggiorare la qualità delle risposte?

Associare il modello AI giusto a ciascun compito porta ai risultati maggiori. I modelli premium eccellono in ragionamento complesso, analisi multi-step o conversazioni sensibili, ma modelli più veloci ed economici gestiscono altrettanto bene le semplici Q&A. Solo questo cambiamento spesso riduce i costi di 3x immediatamente.

2. Che cos’è la context engineering per i chatbot AI e perché è importante?

Context engineering significa controllare intenzionalmente ciò che entra nella finestra di contesto dell’AI a ogni messaggio: prompt di sistema + base di conoscenza + cronologia della conversazione. Questi tre elementi guidano oltre il 90% dei costi in token di input, che controlli completamente. Snellire i prompt e mettere un tetto alla cronologia offre risparmi 5x–20x grazie a scelte di design che chiunque può applicare oggi.

3. Di quanto può ridurre i costi di un chatbot AI la context engineering?

I team che applicano context engineering, prompt di sistema più snelli, recupero della conoscenza basato su RAG e limiti alla cronologia ottengono regolarmente riduzioni di costo di 5x–20x senza cambiare modello AI né sacrificare la qualità delle risposte. Prompt di sistema e gestione della cronologia moltiplicano i risparmi su ogni singolo messaggio, rendendo questa l’ottimizzazione con il massimo impatto per agenzie e sviluppatori.

4. Dovrei disattivare il punteggio CSAT e le funzionalità di memoria per risparmiare sui costi AI?

Disattiva solo i processi AI in background che non stai usando attivamente.

5. Qual è il modo più rapido per ridurre subito i costi in token del chatbot AI?

Rivedi e snellisci il tuo prompt di sistema. Questo singolo testo viene inviato a ogni chiamata AI, per sempre, in tutte le conversazioni. Taglia le istruzioni verbose, rimuovi i duplicati, usa elenchi puntati invece di paragrafi, testa la versione più breve. Vedrai risparmi nel giro di poche ore, spesso con migliore chiarezza.

6. I costi dei chatbot AI diventeranno automaticamente più bassi man mano che i modelli migliorano?

Sì, ma comprendere la meccanica dei token ti dà un vantaggio duraturo. I modelli diventano più efficienti di anno in anno, le piattaforme aggiungono ottimizzazione automatica del contesto e i prezzi calano in modo costante. Chi padroneggia context engineering + selezione del modello sarà sempre avanti rispetto a chi si affida solo ai miglioramenti dei vendor, a prescindere dalla piattaforma.

Il nuovo modello mentale

Le stime danno una direzione basata sulle medie, ed è davvero utile. Le conversazioni reali sono più lunghe, ricche, con funzioni in background attive. Una volta che capisci i driver — dimensione del contesto, processi in background, picchi di traffico — hai vere leve da azionare. La sola context engineering può tagliare i costi di 5x–20x, senza cambiare modello.

"La cosa più costosa nell'AI non è il modello. Sono i token che non ti accorgi di inviare."

Le agenzie e gli sviluppatori che lo padroneggiano costruiscono sistemi più snelli, spiegano i costi ai clienti con sicurezza e scalano in modo prevedibile.

Inizia a costruire in modo più intelligente, prova gratis Invent oggi stesso.