TL;DR

Si vous avez déjà déployé un chatbot IA et constaté que vos coûts réels dépassaient l’estimation, vous avez déjà compris quelque chose d’important : l’usage de l’IA est plus dynamique que ce qu’aucun calculateur ne peut saisir à l’avance. Ce n’est pas un problème, c’est la nature des conversations réelles. Comprendre pourquoi les coûts varient est la première étape pour réellement les maîtriser.

« Ce qu’il y a de plus coûteux dans l’IA, ce n’est pas le modèle. Ce sont les tokens que vous ne saviez pas que vous envoyiez. »

G.H.

1. Ce que les estimateurs de coût réussissent (et leurs limites)

Les calculateurs de coût demandent : Nombre de messages par jour et modèle d’IA. Ils multiplient un coût fixe par message par le volume.

Exemple :

100 messages/jour × 30 jours × 0,0025 $/message ≈ 7,50 $/mois

C’est une base intelligente, et un excellent moyen de comparer des modèles ou d’estimer le ROI avant la mise en production. Ce qu’elle ne peut pas prévoir à l’avance, c’est la manière dont vos conversations réelles se comporteront : leur durée, quelles fonctionnalités sont actives, ou si vous aurez des pics de trafic. Ce n’est pas un défaut du calculateur. C’est simplement la différence entre une estimation et un environnement réel.

2. Comment le contexte influe sur les coûts

L’IA ne lit pas seulement votre dernier message. Elle relit tout, à chaque fois.

Chaque réponse inclut :

- Prompt système (instructions)

- Base de connaissances / contenu de FAQ

- Historique complet de la conversation

- Nouveau message utilisateur

Cette fenêtre de contexte grossit très vite. Le message 1 coûte peu. Le message 30 coûte 30–50x plus, car tout l’historique est rejoué.

Exemple réel : Une réponse a utilisé 22 696 tokens d’entrée (contre 564 en sortie). L’estimation supposait ~500 en entrée. En réalité : 45x plus.

Modèle mental : Ajouter une page à un document, mais réimprimer le document entier à chaque fois.

3. Cinq facteurs clés de coût

- Historique de conversation, renvoyé à chaque fois. Des échanges de 30 messages coûtent 100x+ par rapport à un échange unique.

- Prompts système (Instructions), toujours inclus. 3 000 tokens gonflés vs 300 allégés = 10x d’écart par appel.

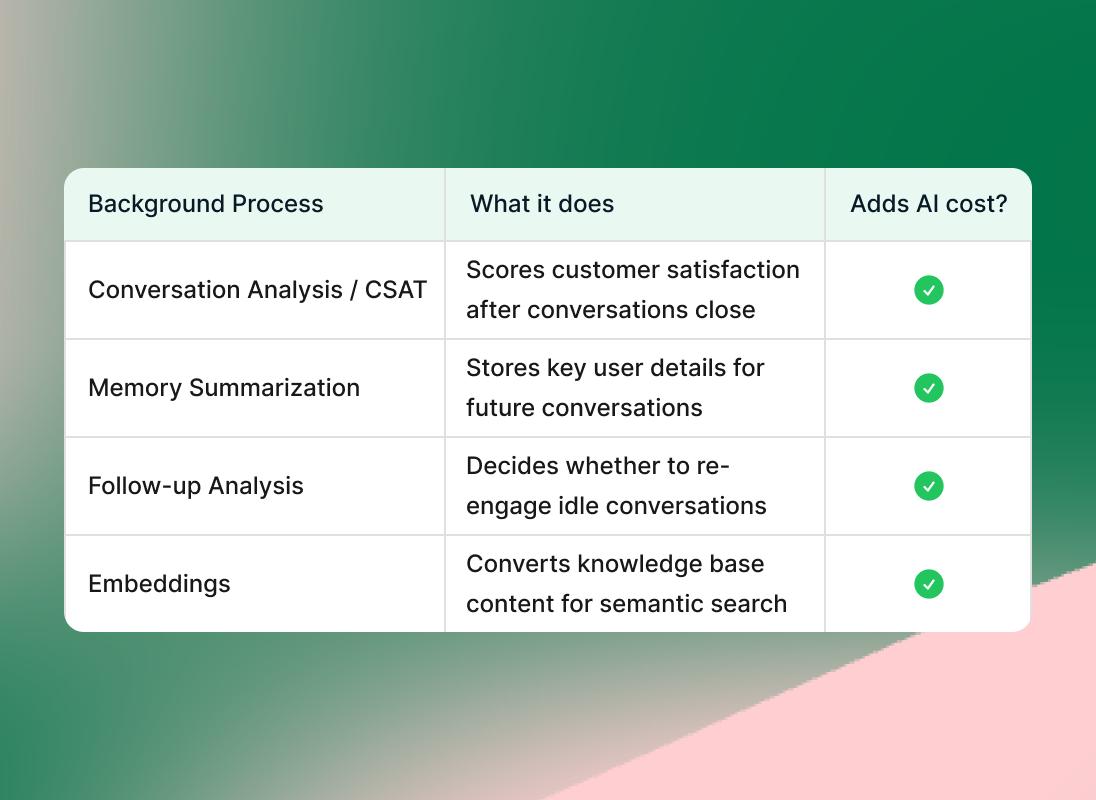

- Processus en arrière-plan, CSAT, synthèse de mémoire, suivis, embeddings. Souvent 3–5 appels d’IA par message.

- Messages média : notes vocales, PDF, images consomment des milliers de tokens chacun.

- Pics de trafic, campagnes virales : des journées à volume ×10 que l’estimation ne pouvait pas prévoir.

Les processus en arrière-plan s’additionnent : les plateformes modernes d’assistants IA exécutent plusieurs tâches invisibles, comme l’analyse de conversation, le suivi et la synthèse de mémoire, qui contribuent chacune à vos coûts d’IA.

4. Principes d’ingénierie du contexte

Des modèles moins chers aident. Mais l’ingénierie du contexte, le fait de façonner délibérément ce qui entre dans la fenêtre de contexte, apporte les plus grands gains. Les tokens d’entrée dominent les coûts, et l’entrée est sous votre contrôle.

Pilier 1 : Prompts système allégés, envoyés à chaque appel, pour toujours.

- Définir le rôle en 2–3 phrases (pas 20)

- Utiliser des puces, pas des paragraphes

- Supprimer les doublons (« soyez toujours poli » une seule fois suffit)

- Écarter les cas limites rares

Cible : < 500 tokens pour simple ; < 1 500 pour complexe

Pilier 2 : Récupération intelligente de connaissances (RAG)

Envoyer toute la FAQ à chaque appel est l’approche naïve. RAG ne récupère que les sections pertinentes pour chaque question précise.

Voici à quoi cela ressemble :

- L’utilisateur pose une question

- Le système recherche dans la FAQ (ou la base de connaissances) les éléments les plus pertinents

- Seules ces sections ciblées et pertinentes sont envoyées à l’IA

- L’IA répond en n’utilisant que ce dont elle a besoin

Voici un exemple de la façon de placer les instructions :

[INSTRUCTIONS]

Vous êtes un assistant de copropriété serviable. Utilisez les infos ci‑dessous pour répondre.

Connaissances pertinentes :

- Horaires de la piscine : lundi–dimanche, 8 h 00 – 22 h 00.

- La piscine ferme pendant les jours fériés et de maintenance.

Question du résident : « Quels sont les horaires de la piscine ? »

Pilier 3 : Gestion de l’historique de conversation

- Fenêtre glissante : seulement les 8–10 derniers messages

- Synthèse : compresser l’ancien historique en faits clés

- Mémoire sélective : ne garder que le contexte pertinent

- Réinitialisation de session : repartir de zéro après la résolution

5. Votre liste d’actions

- Auditez le prompt système, coupez‑le de moitié. Testez la qualité. Vous serez souvent surpris.

- Récupérez, n’injectez pas. Utilisez la recherche sémantique pour ne prendre que le savoir pertinent.

- Limitez l’historique : les 8–10 derniers tours suffisent presque toujours.

- Désactivez les fonctionnalités inutilisées. Coupez CSAT/mémoire si vous n’exploitez pas ces données.

- Faites correspondre le modèle à la tâche. Bon marché/rapide pour le Q&A ; premium seulement pour le raisonnement.

- Concevez pour moins de tours. Des réponses rapides et des parcours structurés réduisent les tours et le coût.

- Filtrez les médias : activez le traitement voix/image/document seulement quand nécessaire.

- Mesurez par évènement : suivez chaque semaine les tokens vs processus en arrière‑plan vs médias.

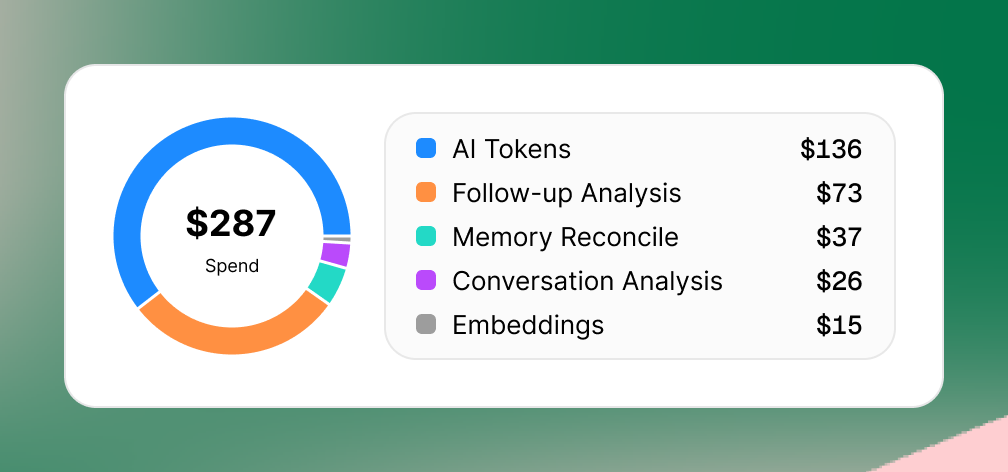

Widget de tableau de bord affichant une dépense IA de 287 $ visualisée par un diagramme en anneau coloré. Une légende détaille les catégories de coût IA : AI Tokens (136 $, bleu), Follow-up Analysis (73 $, orange), Memory Reconcile (37 $, sarcelle), Conversation Analysis (26 $, violet) et Embeddings (15 $, gris), sur un fond en dégradé vert et rose.

FAQ

1. Comment réduire l’usage de tokens dans mon chatbot IA sans nuire à la qualité des réponses ?

Associer le bon modèle d’IA à chaque tâche apporte les plus grands gains. Les modèles premium excellent pour le raisonnement complexe, l’analyse en plusieurs étapes ou les conversations sensibles, mais des modèles plus rapides et moins chers gèrent tout aussi bien les Q&A simples. Ce seul changement réduit souvent les coûts par ×3 immédiatement.

2. Qu’est-ce que l’ingénierie du contexte pour les chatbots IA et pourquoi est-ce important ?

L’ingénierie du contexte consiste à contrôler intentionnellement ce qui entre dans la fenêtre de contexte de l’IA à chaque message : prompt système + base de connaissances + historique de conversation. Ces trois éléments représentent plus de 90 % des tokens d’entrée, que vous contrôlez entièrement. Élaguer les prompts et plafonner l’historique apporte des économies de 5x à 20x grâce à des choix de conception que chacun peut mettre en œuvre dès aujourd’hui.

3. Dans quelle mesure l’ingénierie du contexte peut‑elle réduire les coûts d’un chatbot IA ?

Les équipes qui appliquent l’ingénierie du contexte — prompts système allégés, récupération de connaissances via RAG, plafonds d’historique — obtiennent régulièrement des réductions de coûts de 5x à 20x sans changer de modèles d’IA ni sacrifier la qualité des réponses. Les prompts système et la gestion de l’historique génèrent des économies composées à chaque message, ce qui en fait l’optimisation au meilleur effet de levier pour les agences et les builders.

4. Dois‑je désactiver le scoring CSAT et les fonctionnalités de mémoire pour économiser sur l’IA ?

Ne désactivez que les processus d’IA en arrière‑plan que vous n’utilisez pas activement.

5. Quelle est la façon la plus rapide de réduire dès maintenant les coûts en tokens de votre chatbot IA ?

Auditez et allégez votre prompt système. Ce texte unique est envoyé à chaque appel d’IA, indéfiniment sur toutes les conversations. Coupez les instructions verbeuses, supprimez les doublons, utilisez des puces plutôt que des paragraphes, testez la version courte. Vous verrez des économies en quelques heures, souvent avec une meilleure clarté.

6. Les coûts des chatbots IA vont‑ils baisser automatiquement à mesure que les modèles s’améliorent ?

Oui, mais comprendre la mécanique des tokens vous donne un avantage durable. Les modèles gagnent en efficacité chaque année, les plateformes ajoutent des optimisations automatiques du contexte, et les prix baissent régulièrement. Les builders qui maîtrisent l’ingénierie du contexte + la sélection de modèles dépasseront toujours ceux qui comptent uniquement sur les améliorations des fournisseurs, quelle que soit la plateforme.

Le nouveau modèle mental

Les estimations donnent une direction basée sur des moyennes, et c’est vraiment utile. Les conversations réelles sont plus longues, plus riches, avec des fonctionnalités d’arrière-plan actives. Une fois que vous comprenez les moteurs — taille du contexte, processus en arrière-plan, pics de trafic — vous disposez de vrais leviers. L’ingénierie du contexte à elle seule peut réduire les coûts de 5x à 20x, sans changer de modèle.

« Ce qu’il y a de plus coûteux dans l’IA, ce n’est pas le modèle. Ce sont les tokens que vous ne saviez pas que vous envoyiez. »

Les agences et les builders qui maîtrisent cela conçoivent des systèmes plus légers, expliquent les coûts à leurs clients avec assurance et montent en charge de façon prévisible.

Commencez à construire plus intelligemment, try Invent free today.