TL;DR

La plupart des échecs de l’IA sont des problèmes de contexte.

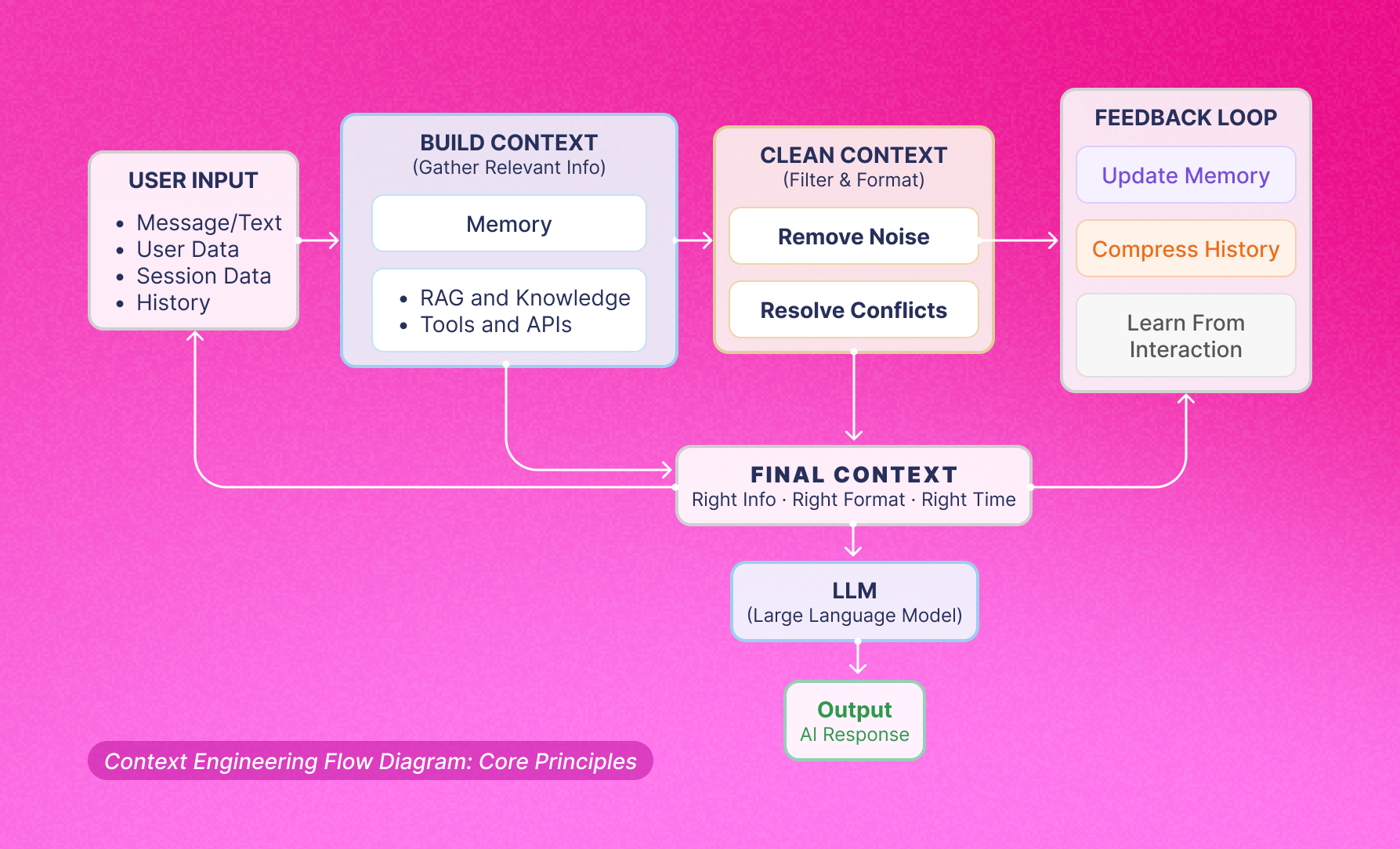

Ingénierie du contexteest la prochaine évolution de la conception des systèmes d’IA : la discipline qui consiste à façonner ce que le modèle sait et voit tout au long d’une interaction. C’est ainsi que l’on transforme des prompts statiques en workflows intelligents qui s’adaptent en temps réel aux utilisateurs, aux tâches et aux outils.

De plus grandes fenêtres de contexte ne sont pas la solution, de meilleurs pipelines de contexte le sont.

1. Ce n’est pas juste « mieux rédiger des prompts »

Beaucoup traitent l’ingénierie du contexte comme du prompt engineering sophistiqué. Ce n’est pas le cas.

Prompt engineering = rédiger une seule chaîne d’entrée

Ingénierie du contexte = concevoir tout un système qui construit dynamiquement ce que le modèle voit, avant, pendant et entre les interactions

L’ingénierie du contexte, c’est ce que devient le prompt engineering quand vous passez de :

L’expérimentation → La mise en production

Une personne → Toute une équipe

Un chat → Un système métier en production

Elle inclut : mémoire, retrieval (RAG), outils, historique de conversation, instructions, état utilisateur, et plus encore.

Le prompt n’est qu’un élément d’un pipeline bien plus vaste, conçu de bout en bout.

Comme Phil Schmid (Hugging Face) le formule, l’ingénierie du contexte, c’est :

La discipline qui consiste à concevoir et construire des systèmes dynamiques fournissant les bonnes informations et les bons outils, au bon format et au bon moment, pour donner à un LLM tout ce dont il a besoin pour accomplir une tâche.

2. Le contexte est dynamique, pas statique

Beaucoup considèrent encore le contexte comme un bloc de texte fixe.

- En réalité, le contexte doit être construit dynamiquement :

- Adapté à chaque requête individuelle.

- Façonné par l’état utilisateur, le temps, la tâche, les données récupérées et les tours de conversation précédents.

- Un contexte statique conduit à des systèmes fragiles qui échouent en situation réelle.

3. Le contexte peut être empoisonné, parasité ou en conflit

Les concepteurs se concentrent souvent uniquement sur le rajout de contexte, en ignorant comment il peut nuire aux performances.

- Modes de défaillance courants :

- Empoisonnement du contexte : informations erronées ou trompeuses.

- Distraction du contexte : informations excessives qui enfouissent les signaux clés.

- Conflit de contexte : instructions contradictoires (depuis le prompt système, les documents récupérés ou l’entrée utilisateur).

4. C’est la raison n°1 pour laquelle les agents échouent

Les erreurs des modèles sont souvent dues à un mauvais contexte, pas à un raisonnement faible du modèle.

- Exemples :

- Informations essentielles manquantes.

- Bruit écrasant qui masque les données clés.

- Absence de mémoire des étapes ou décisions passées.

- Sorties d’outils mal formatées qui entrent dans le prompt.

5. L’ingénierie du contexte est un problème de conception de systèmes

- Souvent prise pour une compétence de rédaction, mais c’est en réalité une question d’architecture et d’orchestration.

- Questions systémiques clés :

- Que stocker en mémoire ?

- Que récupérer, et quand ?

- Comment l’historique de conversation est-il compressé au fil du temps ?

- Comment normaliser les sorties d’outils avant leur entrée dans le contexte ?

- C’est particulièrement critique pour les systèmes multi-agents et conversationnels (par ex., votre assistant WhatsApp pour 30 copropriétés).

6. Plus grandes fenêtres de contexte ≠ Meilleurs résultats

De grandes fenêtres de jetons (p. ex., 1M+) incitent à « tout balancer ».

- Problèmes :

- Les modèles peinent avec l’effet « lost in the middle ».

- Coût et latence plus élevés dus à d’énormes charges de contexte.

- La qualité et la pertinence l’emportent sur la taille brute.

7. Le contexte est le pont entre l’IA et la connaissance du monde réel

- L’ingénierie du contexte permet l’ancrage, rendant l’IA consciente de :

- La logique métier et les règles.

- L’historique utilisateur et de session.

- Les documents et procédures de l’organisation.

- L’état en temps réel de la tâche ou du système.

Sans contexte, même les meilleurs modèles se comportent comme des « génies amnésiques ».

8. Son importance va croître à mesure que les modèles s’améliorent

On croit à tort que des modèles plus intelligents rendent le contexte moins important.

- En réalité :

- Les modèles avancés dépendent davantage d’un contexte riche et structuré.

- Le goulot d’étranglement des performances se déplace de la puissance du modèle → la qualité du contexte.

- Plus le plafond est élevé, plus le besoin d’un contexte de grande précision augmente.

L’essentiel

- L’ingénierie du contexte = l’art et la science de fournir à l’IA la bonne information, au bon moment, dans le bon format.

Les vrais innovateurs pensent au niveau système, en concevant des pipelines intelligents qui rendent l’IA :

- Informée

- Consciente de la situation

- Finement contextualisée

Comment fonctionne l’ingénierie du contexte : l’entrée utilisateur est transformée via la mémoire, la connaissance et la résolution des conflits en un contexte propre et pertinent, puis utilisée par les LLM pour des réponses précises et un apprentissage continu.

FAQ

1. Comment mettre en œuvre la Retrieval Augmented Generation pour améliorer le contexte

La Retrieval Augmented Generation (RAG) combine un système de recherche avec un modèle de langage génératif afin de produire des réponses plus exactes, ancrées et conscientes du contexte.

Pour mettre en œuvre RAG afin d’améliorer le contexte :

- Constituez une base de connaissances : Rassemblez et structurez vos documents, FAQ, manuels ou bases de données propres au domaine dans un vector store (p. ex., Pinecone, Weaviate ou pgvector).

- Organisez et indexez votre contenu: Découpez vos documents en éléments plus petits et digestes et apprenez à l’IA à en comprendre le sens — pas seulement les mots-clés. Cela permet au système de reconnaître l’information pertinente même lorsque les utilisateurs formulent leurs questions différemment.

- Activez une recherche intelligente: Lorsqu’un utilisateur pose une question, le système parcourt automatiquement votre bibliothèque de contenus en arrière-plan et fait remonter les éléments les plus pertinents pour éclairer la réponse, à la manière d’un assistant averti qui sait exactement à quelle page d’un manuel regarder.

- Injectez le contexte dans le prompt: Les morceaux récupérés sont insérés dans le prompt du LLM en tant que contexte, permettant au modèle de générer des réponses ancrées dans vos données spécifiques.

- Obtenez des réponses précises et contextualisées: L’IA combine l’information extraite de votre contenu avec sa connaissance générale pour générer une réponse spécifique, pertinente et utile. En tant qu’utilisateur final, vous pouvez améliorer la qualité des réponses en posant des questions claires et spécifiques, en fournissant des détails pertinents sur votre situation et en donnant du feedback quand une réponse est à côté — chaque correction aide le système à apprendre ce qui compte le plus pour vous.

- Améliorez en continu: Un excellent assistant d’IA n’est jamais vraiment « terminé ». En examinant régulièrement comment les utilisateurs interagissent avec le système, quelles questions sont bien traitées, où il échoue et quels retours ils fournissent, les équipes peuvent affiner et améliorer l’expérience en continu.

RAG est particulièrement puissant pour les bots de support client, les assistants de connaissance internes et toute application où des informations à jour ou propriétaires sont critiques.

2. Comment l’ingénierie du contexte améliore-t-elle l’expérience client dans les services numériques ?

L’ingénierie du contexte améliore radicalement l’expérience client en garantissant que les systèmes d’IA comprennent non seulement ce que l’utilisateur demande, mais aussi qui il est, où il en est dans son parcours et ce dont il a réellement besoin. Voici en quoi cela change la donne :

- Personnalisation à grande échelle : En injectant dans la fenêtre de contexte des historiques utilisateurs, préférences et signaux comportementaux pertinents, les réponses paraissent sur mesure plutôt que génériques.

- Réduction des frictions : Les clients n’ont pas besoin de se répéter. Un contexte bien conçu transporte sans couture les interactions antérieures, les détails de compte et l’état de session entre les points de contact.

- Résolution plus rapide des problèmes : Les agents et chatbots dotés d’un contexte riche peuvent diagnostiquer les problèmes et proposer des solutions en moins de tours, réduisant le temps de traitement et la frustration.

- Assistance proactive : Les systèmes conscients du contexte peuvent anticiper les besoins, par exemple en affichant une FAQ de facturation lorsqu’un utilisateur se rend dans la section paiements, avant même qu’il ne pose la question. Si vous souhaitez approfondir avec des exemples concrets, vous pouvez consulter le Amit Eyal Govrin blog post de Kubiya.ai

- Expérience omnicanale cohérente : Qu’un client contacte par chat, e-mail ou voix, l’ingénierie du contexte assure la continuité et la cohérence sur chaque canal.

- Plus de confiance et de satisfaction : Quand les réponses de l’IA sont pertinentes, exactes et opportunes, les clients se sentent écoutés et valorisés, ce qui améliore directement les scores CSAT et NPS.

Dans les services numériques, la différence entre une expérience frustrante et une expérience remarquable tient souvent à la qualité de la capture, du maintien et de l’exploitation du contexte.

3. Qu’est-ce que l’ingénierie du contexte en intelligence artificielle ?

L’ingénierie du contexte est la discipline consistant à concevoir, structurer et gérer délibérément les informations fournies à un modèle d’IA, en particulier un grand modèle de langage (LLM), afin de maximiser la qualité, la pertinence et l’exactitude de ses sorties.

L’ingénierie du contexte, c’est ce que devient le prompt engineering quand vous passez de :

L’expérimentation → La mise en production

Une personne → Toute une équipe

Un chat → Un système métier en production

4. Comment mettre en œuvre l’ingénierie du contexte dans le développement de chatbots ?

- Définissez vos couches de contexte : Identifiez les types de contexte nécessaires à votre chatbot : données de profil utilisateur, historique de conversation, règles métier, informations en temps réel et connaissances récupérées.

- Concevez une architecture de prompt système : Élaborez un prompt système robuste qui définit le rôle, le ton, les contraintes et les instructions clés du chatbot. C’est la base de votre contexte.

- Mettez en place une mémoire conversationnelle : Utilisez une mémoire à court terme pour maintenir le fil d’une conversation et une mémoire à long terme (stockée en base) pour personnaliser les interactions futures en fonction des sessions passées.

- Intégrez une récupération dynamique de données (RAG) : Connectez votre chatbot à des bases de connaissances internes, des catalogues produits ou de la documentation afin qu’il puisse intégrer à la demande un contexte exact et à jour.

- Appliquez la compression et la synthèse du contexte : À mesure que les conversations s’allongent, résumez les premiers tours pour préserver la fenêtre de contexte pour les informations récentes les plus pertinentes.

- Utilisez une injection de contexte structurée : Formatez les métadonnées utilisateur, les variables de session et le contenu récupéré de manière cohérente et analysable, afin que le modèle puisse les extraire et les utiliser facilement.

- Testez les défaillances de contexte : Identifiez les cas limites où un contexte manquant ou contradictoire conduit à de mauvaises réponses, et mettez en place des mécanismes de repli.

Surveillez et itérez : journalisez le contexte fourni pour chaque interaction et mettez-le en regard des signaux de satisfaction utilisateur afin d’affiner votre stratégie de contexte dans le temps.

Une ingénierie du contexte efficace transforme un chatbot générique en un assistant véritablement intelligent, perçu comme conscient, réactif et digne de confiance par chaque utilisateur qu’il sert.

Mot de la fin

Si vous construisez des assistants d’IA, cessez de penser comme un rédacteur de prompts et commencez à penser comme un ingénieur du contexte.

Votre système n’a pas besoin de plus de jetons, il a besoin d’un contexte plus intelligent.

Commencez à concevoir une ingénierie du contexte qui permette à votre assistant IA vraiment comprendre votre monde.