TL;DR

La mayoría de los fallos de la IA son problemas de contexto.

La ingeniería de contexto es la siguiente evolución del diseño de sistemas de IA: la disciplina de dar forma a lo que el modelo sabe y ve a lo largo de una interacción. Es cómo conviertes prompts estáticos en flujos de trabajo inteligentes que se adaptan a usuarios, tareas y herramientas en tiempo real.

Las ventanas de contexto más grandes no son la respuesta; los mejores pipelines de contexto sí lo son.

1. No es solo «mejorar los prompts»

Mucha gente trata la ingeniería de contexto como una versión sofisticada de la ingeniería de prompts. No lo es.

Ingeniería de prompts = elaborar una única cadena de entrada

Ingeniería de contexto = diseñar todo un sistema que construye dinámicamente lo que el modelo ve, antes, durante y a lo largo de las interacciones

La ingeniería de contexto es en lo que se convierte la ingeniería de prompts cuando pasas de:

Experimentar → Desplegar

Una persona → Todo un equipo

Un chat → Un sistema empresarial en producción

Incluye: memoria, recuperación (Retrieval Augmented Generation, RAG), herramientas, historial de conversación, instrucciones, estado del usuario y más.

El prompt es solo una pieza de un pipeline mucho más amplio y diseñado.

Como Phil Schmid (Hugging Face) lo expresa, la Ingeniería de Contexto es:

La Ingeniería de Contexto es la disciplina de diseñar y construir sistemas dinámicos que proporcionan la información y las herramientas adecuadas, en el formato correcto y en el momento oportuno, para darle a un LLM todo lo que necesita para realizar una tarea.

2. El contexto es dinámico, no estático

Muchos aún tratan el contexto como un bloque de texto fijo.

- En realidad, el contexto debe construirse de forma dinámica:

- Adaptado a cada solicitud individual.

- Moldeado por el estado del usuario, el momento, la tarea, los datos recuperados y los turnos previos de la conversación.

- El contexto estático conduce a sistemas frágiles que fallan en el uso real.

3. El contexto puede contaminarse, distraerse o entrar en conflicto

Quienes construyen sistemas suelen centrarse solo en añadir contexto, ignorando cómo puede perjudicar el rendimiento.

- Formas de fallo comunes:

- Envenenamiento del contexto: información errónea o engañosa.

- Distracción del contexto: información excesiva que entierra las señales clave.

- Choque de contexto: instrucciones en conflicto (del prompt del sistema, documentos recuperados o entrada del usuario).

4. Es la razón principal por la que fallan los agentes

Los errores del modelo a menudo se deben a un mal contexto, no a un razonamiento débil del modelo.

- Algunos ejemplos:

- Falta de información esencial.

- Ruido abrumador que oculta datos clave.

- Falta de memoria de pasos o decisiones pasadas.

- Salidas de herramientas mal formateadas que entran en el prompt.

5. La Ingeniería de Contexto es un problema de diseño de sistemas

- A menudo se confunde con una habilidad de redacción, pero en realidad trata de arquitectura y orquestación.

- Preguntas sistémicas clave:

- ¿Qué se almacena en la memoria?

- ¿Qué se recupera y cuándo?

- ¿Cómo se comprime el historial de la conversación con el tiempo?

- ¿Cómo se normalizan las salidas de las herramientas antes de entrar en el contexto?

- Especialmente crítico para sistemas multiagente y conversacionales (p. ej., tu asistente de WhatsApp para 30 condominios).

6. Ventanas de contexto más grandes ≠ Mejores resultados

Ventanas de tokens grandes (p. ej., 1M+) tientan a los usuarios a «volcarlo todo».

- Problemas:

- Los modelos sufren el efecto «perdido en el medio».

- Mayor coste y latencia por cargas de contexto enormes.

- La calidad y la relevancia superan al tamaño bruto.

7. El contexto es el puente entre la IA y el conocimiento del mundo real

- La ingeniería de contexto permite el grounding, haciendo que la IA sea consciente de:

- La lógica y las reglas del negocio.

- El historial de usuario y de sesión.

- Los documentos y procedimientos de la organización.

- El estado de la tarea o del sistema en tiempo real.

Sin contexto, incluso los mejores modelos se comportan como «personas brillantes con amnesia».

8. Importará aún más a medida que los modelos mejoren

Existe la idea equivocada de que los modelos más inteligentes hacen que el contexto sea menos importante.

- La realidad:

- Los modelos avanzados dependen más de un contexto rico y estructurado.

- El cuello de botella del rendimiento pasa de la potencia del modelo → a la calidad del contexto.

- Cuanto más alto es el techo, mayor es la necesidad de un contexto de precisión.

La conclusión

- La Ingeniería de Contexto = el arte y la ciencia de darle a la IA la información correcta, en el momento oportuno y en el formato adecuado.

Los verdaderos innovadores piensan a nivel de sistema, diseñando pipelines inteligentes que hacen que la IA sea:

- Informada

- Con conciencia situacional

- Precisa en el contexto

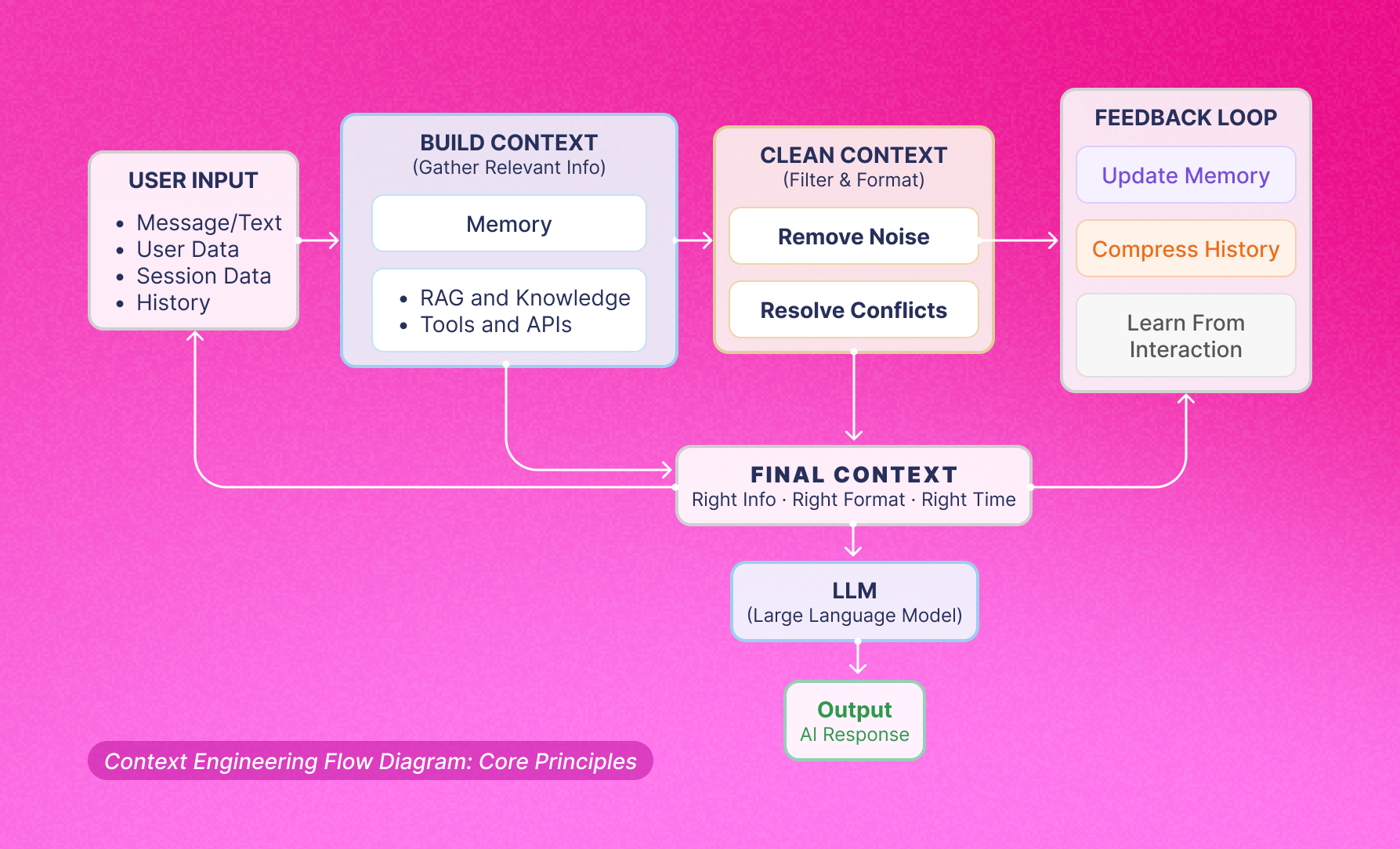

Cómo funciona la ingeniería de contexto: la entrada del usuario se transforma mediante memoria, conocimiento y resolución de conflictos en un contexto limpio y relevante, luego usado por los LLM para respuestas precisas y aprendizaje continuo.

Preguntas frecuentes

1. Cómo implementar Retrieval Augmented Generation (RAG) para mejorar el contexto

Retrieval Augmented Generation (RAG) es una técnica que combina un sistema de recuperación con un modelo de lenguaje generativo para producir respuestas más precisas, fundamentadas y conscientes del contexto.

Para implementar RAG y mejorar el contexto:

- Crea una base de conocimiento: Recopila y estructura tus documentos específicos del dominio, FAQs, manuales o bases de datos en un almacén vectorial (p. ej., Pinecone, Weaviate o pgvector).

- Organiza e indexa tu contenido: Divide tus documentos en piezas más pequeñas y digeribles y enseña a la IA a comprender su significado —no solo sus palabras clave—. Esto permite que el sistema reconozca información relevante incluso cuando los usuarios formulan sus preguntas de manera diferente.

- Activa una búsqueda inteligente: Cuando un usuario pregunta algo, el sistema analiza automáticamente tu biblioteca de contenidos en segundo plano y saca a la superficie las piezas de información más relevantes para fundamentar la respuesta, como un asistente experto que sabe exactamente en qué página del manual mirar.

- Inyecta el contexto en el prompt: Los fragmentos recuperados se insertan en el prompt del LLM como contexto, lo que permite al modelo generar respuestas fundamentadas en tus datos específicos.

- Obtén respuestas precisas y con conciencia de contexto: La IA combina la información recuperada de tu contenido con su conocimiento general para generar una respuesta específica, relevante y útil. Como usuario final, puedes mejorar la calidad de las respuestas haciendo preguntas claras y específicas, proporcionando detalles relevantes sobre tu situación y dando feedback cuando una respuesta no acierta; cada corrección ayuda al sistema a aprender qué es lo que más te importa.

- Sigue mejorando con el tiempo: Un gran asistente de IA nunca está «terminado» del todo. Si revisas periódicamente cómo interactúan los usuarios con el sistema, qué preguntas se responden bien, en qué falla y qué feedback aportan los usuarios, los equipos pueden afinar e ir mejorando continuamente la experiencia.

RAG es especialmente potente para bots de soporte al cliente, asistentes de conocimiento internos y cualquier aplicación donde la información actualizada o propietaria sea crítica.

2. ¿Cómo mejora la ingeniería de contexto la experiencia del cliente en servicios digitales?

La ingeniería de contexto mejora drásticamente la experiencia del cliente al garantizar que los sistemas de IA entienden no solo lo que un usuario pregunta, sino quién es, en qué punto de su recorrido se encuentra y qué necesita realmente. Así marca la diferencia:

- Personalización a escala: Al incorporar historial relevante del usuario, preferencias y señales de comportamiento en la ventana de contexto de la IA, las respuestas se sienten personalizadas y no genéricas.

- Menos fricción: Los clientes no tienen que repetirse. Un contexto bien diseñado arrastra interacciones previas, detalles de la cuenta y el estado de la sesión sin fricciones entre puntos de contacto.

- Resolución de problemas más rápida: Agentes y chatbots con un contexto rico pueden diagnosticar problemas y proponer soluciones en menos turnos, reduciendo el tiempo de gestión y la frustración.

- Asistencia proactiva: Los sistemas con conciencia de contexto pueden anticipar necesidades; por ejemplo, mostrar una FAQ de facturación cuando un usuario navega a la sección de pagos, antes incluso de que pregunte. Si quieres profundizar en ejemplos prácticos puedes visitar la entrada de blog de Amit Eyal Govrin de Kubiya.ai

- Experiencia omnicanal coherente: Ya sea que un cliente se comunique por chat, email o voz, la ingeniería de contexto garantiza continuidad y coherencia en cada canal.

- Mayor confianza y satisfacción: Cuando las respuestas de la IA son relevantes, precisas y oportunas, los clientes se sienten escuchados y valorados, lo que eleva directamente las métricas de CSAT y NPS.

En los servicios digitales, la diferencia entre una experiencia frustrante y una encantadora suele depender de lo bien que se captura, mantiene y utiliza el contexto.

3. ¿Qué es la ingeniería de contexto en inteligencia artificial?

La ingeniería de contexto es la disciplina de diseñar, estructurar y gestionar deliberadamente la información que se proporciona a un modelo de IA, en particular a un modelo de lenguaje grande (LLM), para maximizar la calidad, la relevancia y la precisión de sus resultados.

La ingeniería de contexto es en lo que se convierte la ingeniería de prompts cuando pasas de:

Experimentar → Desplegar

Una persona → Todo un equipo

Un chat → Un sistema empresarial en producción

4. ¿Cómo puedo implementar la ingeniería de contexto en el desarrollo de chatbots?

- Define tus capas de contexto: Identifica qué tipos de contexto necesita tu chatbot: datos del perfil del usuario, historial de conversación, reglas del negocio, información en tiempo real y conocimiento recuperado.

- Diseña una arquitectura de system prompt: Crea un system prompt robusto que establezca el rol del chatbot, el tono, las restricciones y las instrucciones clave. Esta es la base de tu contexto.

- Implementa memoria conversacional: Usa memoria a corto plazo para mantener el flujo de una conversación y memoria a largo plazo (almacenada en una base de datos) para personalizar interacciones futuras basadas en sesiones pasadas.

- Integra recuperación dinámica de datos (RAG): Conecta tu chatbot a bases de conocimiento internas, catálogos de productos o documentación para que pueda incorporar contexto preciso y en tiempo real bajo demanda.

- Aplica compresión y resumen de contexto: A medida que las conversaciones se alargan, resume los turnos anteriores para preservar la ventana de contexto para la información reciente más relevante.

- Usa inyección de contexto estructurado: Da formato a los metadatos del usuario, variables de sesión y contenido recuperado de forma coherente y analizables, para que el modelo pueda extraerlos y usarlos fácilmente.

- Prueba fallos de contexto: Identifica casos límite en los que la falta de contexto o los conflictos conducen a malas respuestas, y crea mecanismos de respaldo.

Supervisa e itera: registra qué contexto se proporcionó en cada interacción y correlaciónalo con señales de satisfacción del usuario para afinar tu estrategia de contexto con el tiempo.

Una ingeniería de contexto eficaz convierte un chatbot genérico en un asistente genuinamente inteligente, que se percibe consciente, receptivo y confiable para cada usuario al que atiende.

Reflexiones finales

Si estás creando asistentes de IA, deja de pensar como un redactor de prompts y empieza a pensar como un ingeniero de contexto.

Tu sistema no necesita más tokens, necesita un contexto más inteligente.

Empieza a diseñar una ingeniería de contexto que haga que tu Asistente de IA realmente entienda tu mundo.