TL;DR

Si alguna vez has implementado un chatbot de IA y has visto que los costos reales superaron la estimación, ya sabes algo importante: el uso de la IA es más dinámico de lo que cualquier calculadora puede capturar por adelantado. No es un problema, es simplemente la naturaleza de las conversaciones reales. Entender por qué varían los costos es el primer paso para controlarlos de verdad.

"Lo más caro en IA no es el modelo. Son los tokens que no te diste cuenta de que estabas enviando."

G.H.

1. Lo que aciertan los estimadores (y sus límites)

Las calculadoras de costos preguntan: mensajes diarios y modelo de IA. Multiplican un costo fijo por mensaje por el volumen.

Ejemplo:

100 mensajes/día × 30 días × $0.0025/mensaje ≈ $7.50/mes

Esta es una base inteligente y una gran manera de comparar modelos o estimar el ROI antes de salir a producción. Lo que no puede predecir por adelantado es cómo se comportarán tus conversaciones reales: cuánto duran, qué funciones están activas o si tendrás picos de tráfico. No es una falla de la calculadora. Es simplemente la diferencia entre una estimación y un entorno en vivo.

2. Cómo el contexto impulsa los costos

La IA no solo lee tu último mensaje. Lee todo, siempre.

Cada respuesta incluye:

- Prompt del sistema (instrucciones)

- Contenido de la base de conocimiento / FAQs

- Historial completo de la conversación

- Nuevo mensaje del usuario

Esta ventana de contexto crece rápido. El mensaje 1 cuesta poco. El mensaje 30 cuesta 30–50× más porque el historial se vuelve a procesar por completo.

Ejemplo real: Una respuesta usó 22,696 tokens de entrada (vs. 564 de salida). La estimación asumía ~500 de entrada. Realidad: 45× más.

Modelo mental: Agregar una página a un documento, pero volver a imprimir el documento completo cada vez.

3. Cinco factores clave de costo

- Historial de conversación, se envía cada vez. Chats de 30 mensajes cuestan 100×+ que intercambios de un solo turno.

- Prompts del sistema, también llamados Instrucciones, siempre incluidos. 3,000 tokens inflados vs. 300 ajustados = 10× de diferencia por llamada.

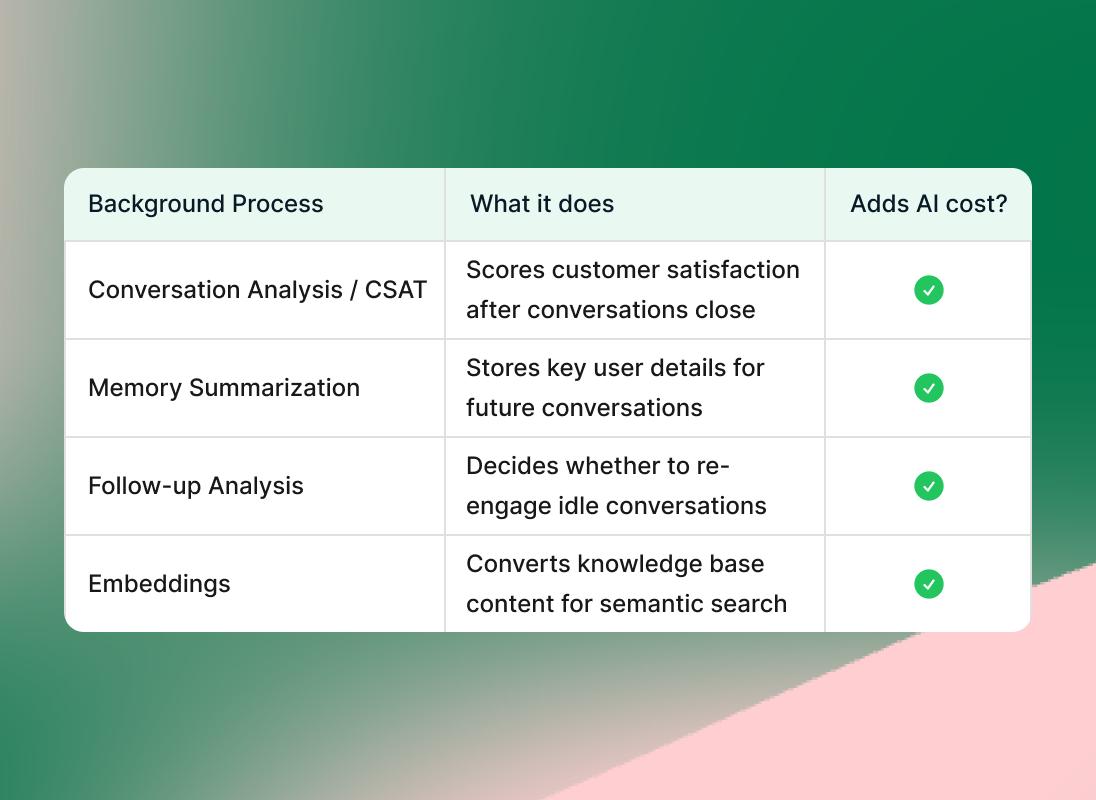

- Procesos en segundo plano, CSAT, resúmenes de memoria, seguimientos, embeddings. A menudo 3–5 llamadas de IA por mensaje.

- Mensajes con contenido multimedia, notas de voz, PDFs, imágenes consumen miles de tokens cada uno.

- Picos de tráfico, campañas virales crean días con 10× el volumen que la estimación no pudo prever.

Los procesos en segundo plano se acumulan: Las plataformas modernas de asistentes de IA ejecutan múltiples tareas tras bambalinas, como análisis de conversaciones, seguimiento y resúmenes de memoria, que cada una aporta a tus costos de IA.

4. Principios de ingeniería de contexto

Los modelos más baratos ayudan. Pero ingeniería de contexto, dar forma deliberada a lo que entra en la ventana de contexto, ofrece las mayores ganancias. Los tokens de entrada dominan los costos, y la entrada está bajo tu control.

Pilar 1: Prompts del sistema ajustados, enviados en cada llamada, para siempre.

- Define el rol en 2–3 oraciones (no 20)

- Usa viñetas, no párrafos

- Elimina duplicados (“sé siempre cortés” una vez es suficiente)

- Omite casos extremos poco frecuentes

Objetivo: <500 tokens para simple; <1,500 para complejo

Pilar 2: Recuperación inteligente de conocimiento (RAG)

Volcar todas las preguntas frecuentes (FAQs) en cada llamada es el enfoque ingenuo. RAG recupera solo las secciones relevantes para cada pregunta específica.

Así funciona:

- El usuario hace una pregunta

- El sistema busca en las preguntas frecuentes (o base de conocimiento) los fragmentos más relevantes

- Solo esas secciones específicas y relevantes se envían a la IA

- La IA responde usando solo lo que necesita

Este es un ejemplo de cómo puedes colocar las instrucciones:

[INSTRUCTIONS]

Eres un asistente útil para condominios. Usa la información a continuación para responder.

Conocimiento relevante:

- Horario de la piscina: lunes a domingo, 8:00 AM – 10:00 PM.

- La piscina cierra durante festivos y días de mantenimiento.

Pregunta del residente: "¿Cuál es el horario de la piscina?"

Pilar 3: Gestión del historial de conversación

- Ventana deslizante: Solo los últimos 8–10 mensajes

- Resumen: Comprime el historial antiguo en hechos clave

- Memoria selectiva: Conserva solo el contexto significativo

- Reinicio de sesión: Comienzo limpio tras la resolución

5. Tu lista de acciones

- Audita el prompt del sistema, recórtalo a la mitad. Prueba la calidad. Normalmente te sorprenderás.

- Recupera, no inyectes. Usa búsqueda semántica solo para el conocimiento relevante.

- Limita el historial; los últimos 8–10 turnos casi siempre bastan.

- Desactiva funciones no usadas. Apaga CSAT/memoria si no estás actuando sobre esos datos.

- Adecua el modelo a la tarea. Barato/rápido para Q&A; premium solo para razonamiento.

- Diseña para menos turnos. Respuestas rápidas y flujos estructurados reducen turnos y costo.

- Controla el uso de multimedia: habilita procesamiento de voz/imagen/documento solo cuando sea necesario.

- Monitorea por evento. Haz seguimiento semanal de tokens vs. procesos en segundo plano vs. multimedia.

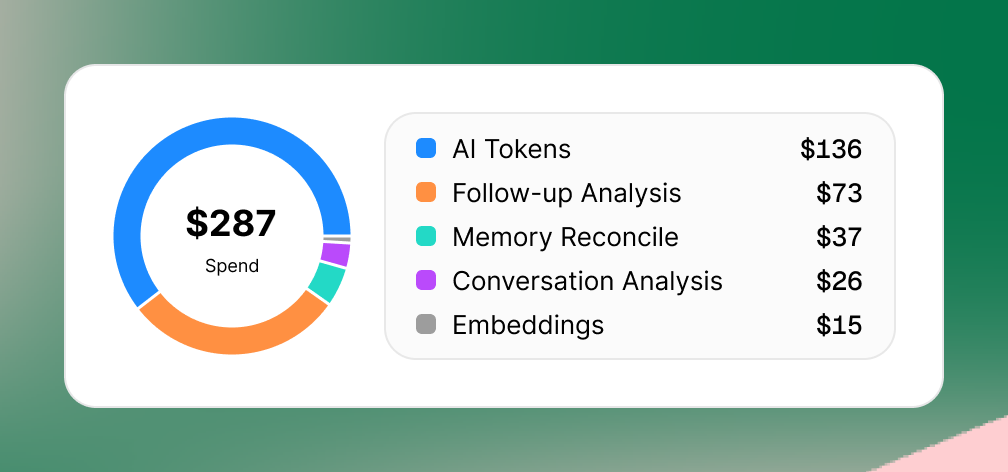

Widget de tablero que muestra un gasto en IA de $287 visualizado con un gráfico de dona a color. Una leyenda detalla las categorías de costo de IA: AI Tokens ($136, azul), Follow-up Analysis ($73, naranja), Memory Reconcile ($37, turquesa), Conversation Analysis ($26, morado) y Embeddings ($15, gris), sobre un fondo con degradado verde y rosa.

Preguntas frecuentes

1. ¿Cómo reduzco el uso de tokens en mi chatbot de IA sin perjudicar la calidad de las respuestas?

Asignar el modelo de IA adecuado a cada tarea ofrece las mayores ganancias. Los modelos premium sobresalen en razonamiento complejo, análisis de varios pasos o conversaciones sensibles, pero los modelos más rápidos y baratos manejan igual de bien el Q&A directo. Este único cambio a menudo reduce costos 3× de inmediato.

2. ¿Qué es la ingeniería de contexto para chatbots de IA y por qué importa?

La ingeniería de contexto significa controlar intencionalmente qué entra en la ventana de contexto de la IA en cada mensaje: prompt del sistema + base de conocimiento + historial de conversación. Estos tres elementos impulsan más del 90% de los costos de tokens de entrada, los cuales controlas por completo. Recortar prompts y limitar el historial ofrece ahorros de 5×–20× mediante decisiones de diseño que cualquiera puede implementar hoy.

3. ¿Cuánto puede reducir la ingeniería de contexto los costos de un chatbot de IA?

Los equipos que aplican ingeniería de contexto, prompts de sistema más ajustados, recuperación de conocimiento basada en RAG y límites al historial de conversación logran de forma habitual reducciones de costos de 5×–20× sin cambiar modelos de IA ni sacrificar la calidad de las respuestas. Los prompts del sistema y la gestión del historial generan ahorros compuestos en cada mensaje, convirtiéndolo en la optimización de mayor impacto para agencias y creadores.

4. ¿Debería desactivar la puntuación de CSAT y las funciones de memoria para ahorrar costos de IA?

Desactiva únicamente los procesos de IA en segundo plano que no estés usando activamente.

5. ¿Cuál es la forma más rápida de reducir ahora mismo los costos de tokens de tu chatbot de IA?

Audita y recorta tu prompt del sistema. Este único texto se envía en cada llamada de IA, para siempre, en todas las conversaciones. Recorta instrucciones verbosas, elimina duplicados, usa viñetas en lugar de párrafos, prueba la versión más corta. Verás ahorros en cuestión de horas, a menudo con mejor claridad.

6. ¿Los costos de los chatbots de IA bajarán automáticamente a medida que mejoren los modelos?

Sí, pero entender la mecánica de los tokens te da una ventaja duradera. Los modelos se vuelven más eficientes cada año, las plataformas agregan optimización automática del contexto y los precios bajan de forma constante. Quienes dominen la ingeniería de contexto + la selección de modelos siempre superarán a quienes dependen solo de las mejoras de los proveedores, sin importar la plataforma.

El nuevo modelo mental

Las estimaciones dan dirección basadas en promedios, y eso es realmente útil. Las conversaciones reales son más largas, más ricas y con funciones en segundo plano activas. Una vez que comprendes los impulsores: tamaño del contexto, procesos en segundo plano, picos de tráfico, tienes palancas reales que accionar. Solo la ingeniería de contexto puede reducir los costos 5×–20×, sin necesidad de cambiar de modelo.

"Lo más caro en IA no es el modelo. Son los tokens que no te diste cuenta de que estabas enviando."

Las agencias y los creadores que dominan esto construyen sistemas más ligeros, explican los costos con seguridad a los clientes y escalan de forma predecible.

Empieza a construir con más inteligencia, prueba Invent gratis hoy.