TL;DR

Wenn Sie jemals einen AI-Chatbot ausgerollt haben und festgestellt haben, dass Ihre tatsächlichen Kosten höher als die Schätzung sind, wissen Sie bereits etwas Wichtiges: Die AI-Nutzung ist dynamischer, als es ein Rechner im Voraus vollständig abbilden kann. Das ist kein Problem – es ist die Natur echter Gespräche. Zu verstehen, warum Kosten schwanken, ist der erste Schritt, um sie wirklich zu steuern.

„Das Teuerste an AI ist nicht das Modell. Es sind die Token, von denen Sie nicht gemerkt haben, dass Sie sie senden.“

G.H.

1. Was Schätzer richtig machen (und wo ihre Grenzen liegen)

Kostenrechner fragen: nach der täglichen Nachrichtenanzahl und dem AI-Modell. Sie multiplizieren einen festen Preis pro Nachricht mit dem Volumen.

Beispiel:

100 Nachrichten/Tag × 30 Tage × $0.0025/Nachricht ≈ $7.50/Monat

Das ist eine smarte Basis und eine gute Methode, um Modelle zu vergleichen oder den ROI vor dem Go-live abzuschätzen. Was sie jedoch nicht vorhersagen kann, ist, wie sich echte Gespräche verhalten: wie lange sie laufen, welche Features aktiv sind oder ob es Traffic-Spitzen gibt. Das ist kein Fehler des Rechners – es ist einfach der Unterschied zwischen einer Schätzung und einer Live-Umgebung.

2. Wie Kontext die Kosten treibt

AI liest nicht nur Ihre letzte Nachricht. Sie liest jedes Mal alles.

Jede Antwort enthält:

- System-Prompt (Anweisungen)

- Wissensbasis-/FAQ-Inhalte

- Voller Konversationsverlauf

- Neue Nutzernachricht

Dieses Kontextfenster wächst schnell. Nachricht 1 kostet wenig. Nachricht 30 kostet 30–50× mehr, da der gesamte Verlauf jedes Mal erneut mitläuft.

Reales Beispiel: Eine Antwort nutzte 22.696 Input-Token (vs. 564 Output). Die Schätzung ging von ~500 Input aus. Realität: 45× höher.

Denkmodell: Sie fügen einem Dokument eine Seite hinzu, drucken aber jedes Mal das gesamte Dokument neu.

3. Fünf wesentliche Kostentreiber

- Konversationsverlauf, jedes Mal mitgesendet. Chats mit 30 Nachrichten kosten 100× so viel wie einzelne Austausche.

- System-Prompts bzw. Anweisungen, immer enthalten. 3.000 aufgeblähte Token vs. 300 schlanke = 10× Unterschied pro Aufruf.

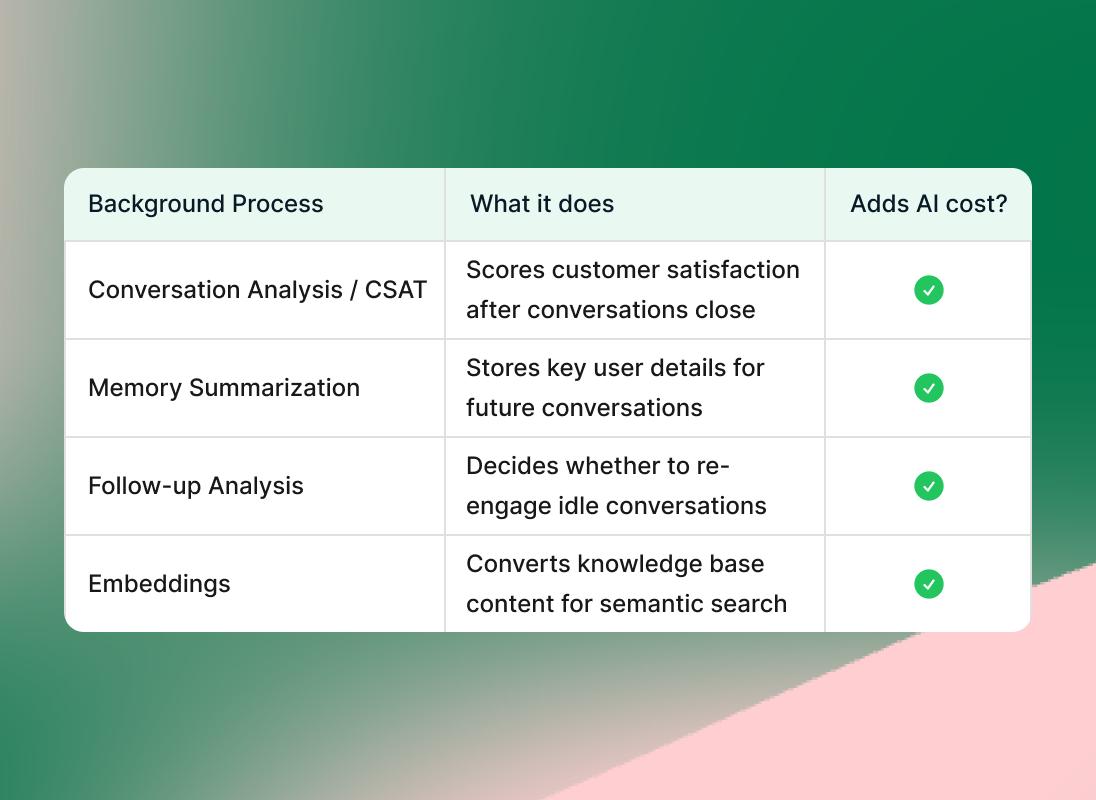

- Hintergrundprozesse, CSAT, Memory Summarization, Follow-ups, Embeddings. Oft 3–5 AI-Aufrufe pro Nachricht.

- Mediennachrichten: Sprachnotizen, PDFs, Bilder verbrauchen jeweils Tausende von Token.

- Traffic-Spitzen, virale Kampagnen erzeugen 10× Volumentage, die die Schätzung nicht vorhersehen konnte.

Hintergrundprozesse summieren sich: Moderne AI-Assistenten-Plattformen führen mehrere Aufgaben im Hintergrund aus – etwa Konversationsanalyse, Follow-ups und Memory Summarization –, die jeweils zu Ihren AI-Kosten beitragen.

4. Prinzipien des Kontext-Engineerings

Günstigere Modelle helfen. Aber Kontext-Engineering, also das bewusste Gestalten dessen, was ins Kontextfenster gelangt, bringt die größten Gewinne. Input-Token dominieren die Kosten – und den Input können Sie steuern.

Säule 1: Schlanke System-Prompts, die bei jedem Aufruf, für immer, gesendet werden.

- Rolle in 2–3 Sätzen definieren (nicht in 20)

- Aufzählungen statt Absätzen verwenden

- Duplikate streichen („immer höflich sein“ einmal genügt)

- Seltene Edge Cases streichen

Ziel: <500 Token bei einfach; <1.500 bei komplex

Säule 2: Smarte Wissensabfrage (RAG)

In jede Anfrage die kompletten FAQs zu kippen, ist der naive Ansatz. RAG holt nur die relevanten Abschnitte für jede konkrete Frage.

So sieht das aus:

- Der Nutzer stellt eine Frage

- Das System durchsucht die FAQ (oder Wissensbasis) nach den relevantesten Teilen

- Nur diese spezifischen, relevanten Abschnitte werden an die AI gesendet

- Die AI antwortet nur mit dem, was sie braucht

So können Sie die Anweisungen platzieren:

[ANWEISUNGEN]

Sie sind ein hilfreicher Assistent für eine Wohnanlage. Verwenden Sie die folgenden Informationen, um zu antworten.

Relevantes Wissen:

- Pool-Öffnungszeiten: Montag–Sonntag, 08:00–22:00 Uhr.

- Der Pool ist an Feiertagen und Wartungstagen geschlossen.

Bewohnerfrage: „Wie sind die Pool-Öffnungszeiten?“

Säule 3: Verwaltung des Konversationsverlaufs

- Gleitendes Fenster: Nur die letzten 8–10 Nachrichten

- Zusammenfassung: Alten Verlauf zu Schlüsselfakten komprimieren

- Selektives Gedächtnis: Nur bedeutsamen Kontext behalten

- Sitzung zurücksetzen: Neustart nach Lösung

5. Ihre Aktions-Checkliste

- System-Prompt prüfen und halbieren. Qualität testen. Meistens werden Sie überrascht sein.

- Abrufen, nicht injizieren. Verwenden Sie semantische Suche nur für relevantes Wissen.

- Verlauf begrenzen; die letzten 8–10 Züge reichen fast immer.

- Unbenutzte Features deaktivieren. CSAT/Memory ausschalten, wenn Sie die Daten nicht nutzen.

- Modell zur Aufgabe passend wählen. Günstig/schnell für Q&A; Premium nur für komplexes Reasoning.

- Für weniger Züge gestalten. Kurze Antworten und strukturierte Flows reduzieren Züge und Kosten.

- Medien steuern: Sprach-/Bild-/Dokumentenverarbeitung nur bei Bedarf aktivieren.

- Ereignisbezogen überwachen: Token vs. Hintergrundprozesse vs. Medien wöchentlich verfolgen.

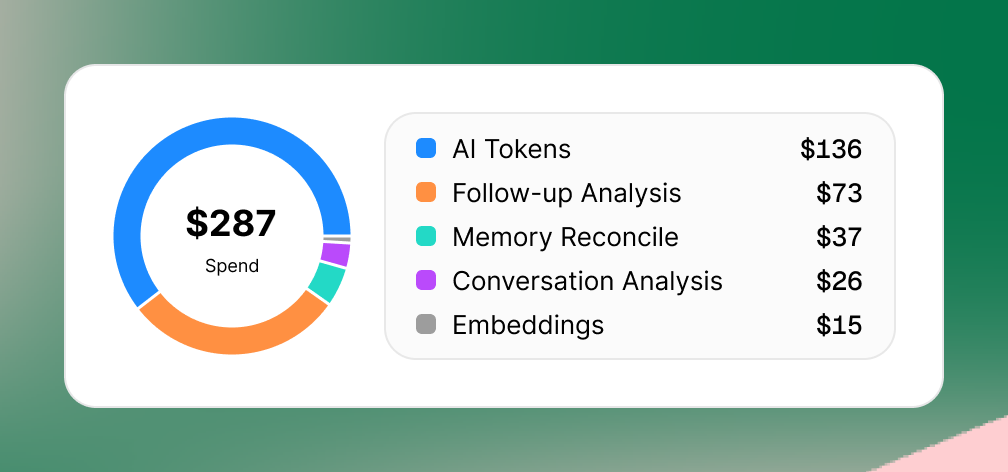

Dashboard-Widget mit $287 AI-Ausgaben, visualisiert als farbiger Donut-Chart. Eine Legende itemisiert AI-Kostenkategorien: AI Token ($136, blau), Follow-up Analysis ($73, orange), Memory Reconcile ($37, türkis), Conversation Analysis ($26, violett) und Embeddings ($15, grau), auf einem grün und rosa Farbverlauf.

FAQs

1. Wie reduziere ich den Token-Verbrauch in meinem AI-Chatbot, ohne die Antwortqualität zu verschlechtern?

Die zu jeder Aufgabe passende Wahl des AI-Modells bringt die größten Erfolge. Premium-Modelle glänzen bei komplexem Reasoning, mehrstufigen Analysen oder sensiblen Gesprächen, aber schnellere, günstigere Modelle bewältigen unkomplizierte Q&A genauso gut. Allein diese Umstellung senkt die Kosten oft sofort um den Faktor 3.

2. Was ist Kontext-Engineering für AI-Chatbots und warum ist es wichtig?

Kontext-Engineering bedeutet, bei jeder Nachricht gezielt zu steuern, was in das Kontextfenster der AI gelangt: System-Prompt + Wissensbasis + Konversationsverlauf. Diese drei Elemente treiben über 90 % der Input-Token-Kosten – und Sie haben sie vollständig unter Kontrolle. Gekürzte Prompts und ein begrenzter Verlauf liefern 5×–20× Einsparungen durch Designentscheidungen, die jeder heute umsetzen kann.

3. Wie stark kann Kontext-Engineering die AI-Chatbot-Kosten senken?

Teams, die Kontext-Engineering anwenden – schlankere System-Prompts, RAG-basierte Wissensabfrage, Kappung des Konversationsverlaufs –, erreichen routinemäßig 5×–20× Kostensenkungen, ohne AI-Modelle zu wechseln oder Antwortqualität einzubüßen. System-Prompts und Verlauf-Management erzeugen kumulierte Einsparungen bei jeder einzelnen Nachricht und sind damit die wirkungsvollste Optimierung für Agenturen und Builder.

4. Sollte ich CSAT-Scoring und Memory-Funktionen deaktivieren, um AI-Kosten zu sparen?

Deaktivieren Sie nur Hintergrundprozesse der AI, die Sie nicht aktiv nutzen.

5. Was ist der schnellste Weg, um die Token-Kosten Ihres AI-Chatbots sofort zu senken?

Prüfen und kürzen Sie Ihren System-Prompt. Dieser eine Text wird mit jeder AI-Anfrage, dauerhaft in allen Unterhaltungen, mitgesendet. Kürzen Sie ausschweifende Anweisungen, entfernen Sie Duplikate, nutzen Sie Aufzählungen statt Absätzen, testen Sie die kürzere Version. Sie sehen Einsparungen binnen Stunden – oft mit besserer Klarheit.

6. Werden AI-Chatbot-Kosten automatisch günstiger, wenn sich Modelle verbessern?

Ja, aber das Verständnis der Token-Mechanik verschafft Ihnen einen dauerhaften Vorteil. Modelle werden jährlich effizienter, Plattformen fügen automatische Kontextoptimierung hinzu, und die Preise sinken stetig. Builder, die Kontext-Engineering plus Modellauswahl meistern, werden stets diejenigen übertreffen, die allein auf Verbesserungen der Anbieter setzen – plattformunabhängig.

Das neue Denkmodell

Schätzungen geben auf Basis von Durchschnittswerten die Richtung vor – und das ist wirklich nützlich. Reale Gespräche laufen länger und vielfältiger, mit aktiven Hintergrundfunktionen. Sobald Sie die Treiber verstehen – Kontextgröße, Hintergrundprozesse, Traffic-Spitzen – haben Sie echte Stellhebel. Allein Kontext-Engineering kann die Kosten um den Faktor 5×–20× senken – ganz ohne Modellwechsel.

„Das Teuerste an AI ist nicht das Modell. Es sind die Token, von denen Sie nicht gemerkt haben, dass Sie sie senden.“

Agenturen und Builder, die das beherrschen, bauen schlankere Systeme, erklären Kunden die Kosten souverän und skalieren planbar.

Beginnen Sie, smarter zu bauen, probieren Sie Invent heute kostenlos aus.