TL;DR

Die meisten Fehler von KI-Systemen sind Kontextprobleme.

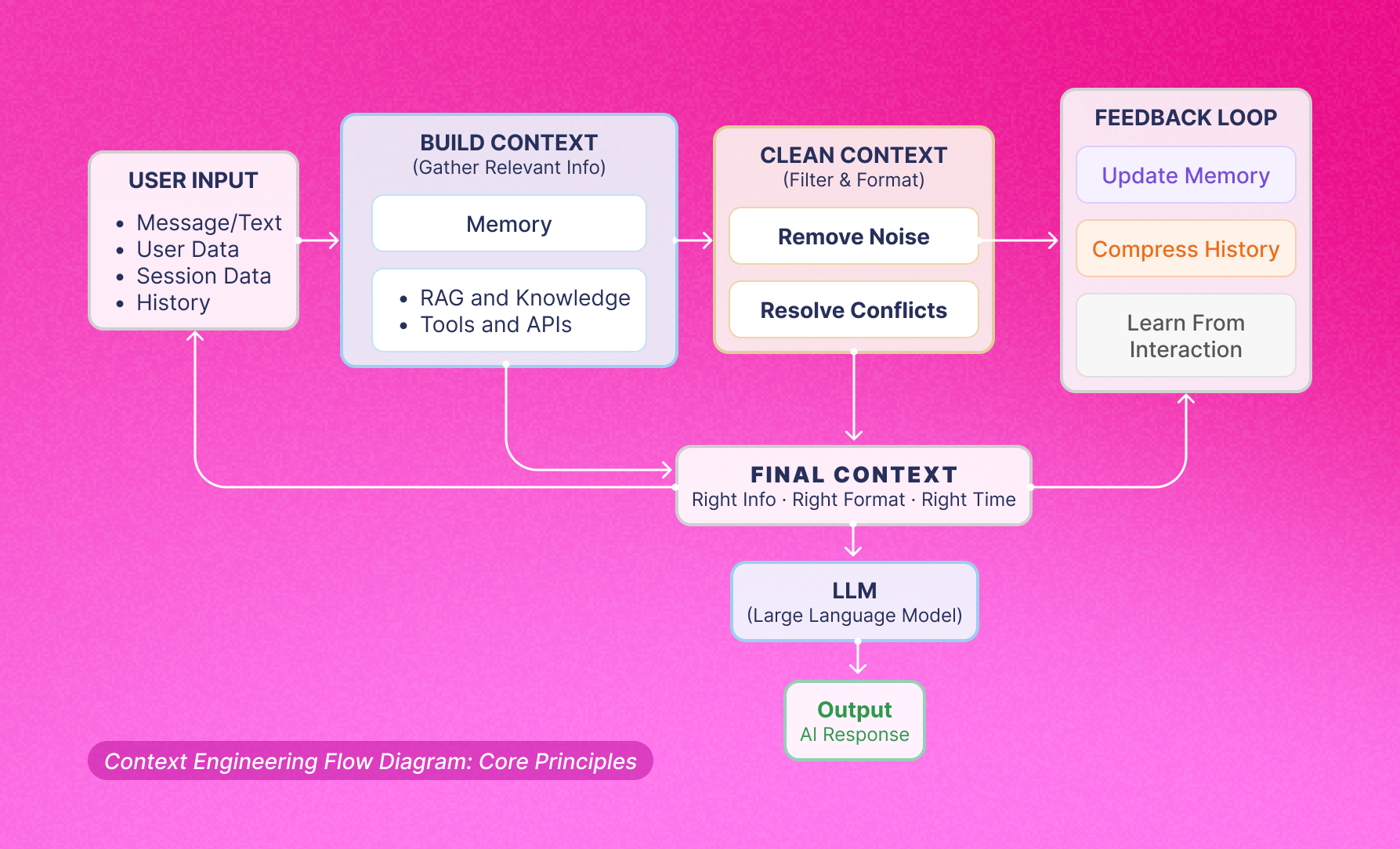

Kontext-Engineering ist die nächste Evolutionsstufe des KI-Systemdesigns: die Disziplin, die bestimmt, was das Modell während einer Interaktion weiß und sieht. So verwandelst du statische Prompts in intelligente Workflows, die sich in Echtzeit an Nutzer, Aufgaben und Tools anpassen.

Größere Kontextfenster sind nicht die Lösung – bessere Kontext-Pipelines schon.

1. Es geht nicht nur um „besseres Prompting“

Viele halten Kontext-Engineering für schickes Prompt-Engineering. Ist es nicht.

Prompt-Engineering = das Formulieren eines einzelnen Eingabestrings

Kontext-Engineering = das Entwerfen eines Gesamtsystems, das dynamisch konstruiert, was das Modell vor, während und über Interaktionen hinweg sieht

Kontext-Engineering ist das, wozu Prompt-Engineering wird, wenn du den Schritt machst von:

Experimentieren → Bereitstellen

Einer Person → Einem ganzen Team

Einem einzelnen Chat → Einem produktiven Business-System

Dazu gehören: Speicher, Retrieval (RAG), Tools, Gesprächsverlauf, Anweisungen, Nutzerzustand und mehr.

Der Prompt ist nur ein Teilstück einer viel größeren, ingenieurmäßig aufgebauten Pipeline.

Wie Phil Schmid (Hugging Face) es ausdrückt, ist Kontext-Engineering:

Kontext-Engineering ist die Disziplin, dynamische Systeme zu entwerfen und zu bauen, die zur richtigen Zeit die richtigen Informationen und Tools im richtigen Format bereitstellen, damit ein LLM alles hat, was es zur Erledigung einer Aufgabe benötigt.

2. Kontext ist dynamisch, nicht statisch

Viele behandeln Kontext noch immer wie einen festen Textblock.

- In Wirklichkeit muss Kontext dynamisch aufgebaut werden:

- Zugeschnitten auf jede einzelne Anfrage.

- Geprägt durch Nutzerzustand, Zeitpunkt, Aufgabe, abgerufene Daten und frühere Gesprächsbeiträge.

- Statischer Kontext führt zu fragilen Systemen, die im Realbetrieb versagen.

3. Kontext kann vergiftet, abgelenkt oder widersprüchlich sein

Teams konzentrieren sich häufig nur aufs Hinzufügen von Kontext und ignorieren, wie er die Leistung beeinträchtigen kann.

- Häufige Fehlermuster:

- Kontext-Vergiftung: falsche oder irreführende Informationen.

- Kontext-Ablenkung: übermäßige Informationen, die Schlüsselsignale überdecken.

- Kontext-Konflikt: widersprüchliche Anweisungen (aus System-Prompt, abgerufenen Dokumenten oder Nutzereingaben).

4. Das ist Grund Nr. 1, warum Agenten scheitern

Modellfehler werden oft durch schlechten Kontext verursacht, nicht durch schwache Schlussfolgerungen des Modells.

- Beispiele:

- Fehlende wesentliche Informationen.

- Übermäßiges Rauschen, das Kerndaten verdeckt.

- Fehlendes Gedächtnis für frühere Schritte oder Entscheidungen.

- Schlecht formatierte Tool-Ausgaben, die in den Prompt gelangen.

5. Kontext-Engineering ist ein Systemdesign-Problem

- Wird oft mit einer Schreibfertigkeit verwechselt, geht in Wahrheit aber um Architektur und Orchestrierung.

- Zentrale systemische Fragen:

- Was wird im Speicher abgelegt?

- Was wird wann abgerufen?

- Wie wird der Gesprächsverlauf über die Zeit komprimiert?

- Wie werden Tool-Ausgaben normalisiert, bevor sie in den Kontext eingehen?

- Besonders kritisch für Multi-Agent- und konversationelle Systeme (z. B. dein WhatsApp-Assistent für 30 Wohnanlagen).

6. Größere Kontextfenster ≠ bessere Ergebnisse

Große Token-Fenster (z. B. 1M+) verleiten dazu, „einfach alles reinzukippen“.

- Probleme:

- Modelle kämpfen mit dem „Lost-in-the-Middle“-Effekt.

- Höhere Kosten und Latenzen durch riesige Kontext-Payloads.

- Qualität und Relevanz schlagen schiere Größe.

7. Kontext ist die Brücke zwischen KI und Wissen aus der realen Welt

- Kontext-Engineering ermöglicht Grounding und macht KI bewusst für:

- Business-Logik und Regeln.

- Nutzer- und Sitzungsverlauf.

- Unternehmensdokumente und -prozesse.

- Echtzeit-Zustand von Aufgabe oder System.

Ohne Kontext verhalten sich selbst Top-Modelle wie „brillante Menschen mit Amnesie“.

8. Mit besseren Modellen wird es noch wichtiger

Es gibt das Missverständnis, dass klügere Modelle Kontext weniger wichtig machen.

- In Wirklichkeit:

- Fortgeschrittene Modelle sind stärker angewiesen auf reichen, strukturierten Kontext.

- Der Engpass verschiebt sich von der Modellstärke → zur Kontextqualität.

- Je höher das Potenzial, desto größer der Bedarf an präzisem Kontext.

Fazit

- Kontext-Engineering = die Kunst und Wissenschaft, KI zur richtigen Information, zur richtigen Zeit, im richtigen Format zu verhelfen.

Die echten Innovatoren denken auf Systemebene, und entwerfen intelligente Pipelines, die KI:

- Informiert

- Situationsbewusst

- Kontextsensibel

So funktioniert Kontext-Engineering: Nutzereingaben werden über Speicher, Wissen und Konfliktlösung in sauberen, relevanten Kontext verwandelt und dann von LLMs für präzise Antworten und kontinuierliches Lernen genutzt.

FAQs

1. Wie implementiere ich Retrieval Augmented Generation (RAG) für besseren Kontext

Retrieval Augmented Generation (RAG) ist eine Technik, die ein Retrieval-System mit einem generativen Sprachmodell kombiniert, um genauere, fundierte und kontextbewusste Antworten zu erzeugen.

So setzt du RAG für besseren Kontext um:

- Baue eine Wissensbasis auf: Sammle und strukturiere deine domänenspezifischen Dokumente, FAQs, Handbücher oder Datenbanken in einer Vektordatenbank (z. B. Pinecone, Weaviate oder pgvector).

- Organisiere und indexiere deine Inhalte: Teile deine Dokumente in kleinere, verdauliche Einheiten und bringe der KI bei, ihre Bedeutung zu verstehen – nicht nur ihre Schlüsselwörter. So kann das System relevante Informationen erkennen, selbst wenn Nutzer ihre Fragen anders formulieren.

- Ermögliche smarte Suche: Wenn ein Nutzer etwas fragt, durchsucht das System im Hintergrund automatisch deine Content-Bibliothek und fördert die relevantesten Informationsbausteine zutage, um die Antwort zu untermauern – ähnlich wie ein kenntnisreicher Assistent, der genau weiß, auf welcher Seite eines Handbuchs er nachsehen muss.

- Injiziere Kontext in den Prompt: Die abgerufenen Chunks werden als Kontext in den Prompt des LLM eingefügt, sodass das Modell Antworten erzeugen kann, die in deinen spezifischen Daten verankert sind.

- Erhalte präzise, kontextbewusste Antworten: Die KI kombiniert die aus deinen Inhalten abgerufenen Informationen mit ihrem eigenen breiten Wissen, um eine Antwort zu generieren, die spezifisch, relevant und hilfreich ist. Als Endnutzer kannst du die Qualität der Antworten verbessern, indem du klare, spezifische Fragen stellst, relevante Details zu deiner Situation angibst und Feedback gibst, wenn eine Antwort danebenliegt – jede Korrektur hilft dem System zu lernen, was dir am wichtigsten ist.

- Laufend verbessern: Ein großartiger KI-Assistent ist nie wirklich „fertig“. Indem Teams regelmäßig prüfen, wie Nutzer mit dem System interagieren, welche Fragen gut beantwortet werden, wo es schwächelt und welches Feedback Nutzer geben, lässt sich das Nutzererlebnis kontinuierlich feinjustieren und verbessern.

RAG ist besonders wirkungsvoll für Customer-Support-Bots, interne Wissensassistenten und alle Anwendungen, in denen aktuelle oder proprietäre Informationen entscheidend sind.

2. Wie verbessert Kontext-Engineering die Customer Experience in digitalen Services?

Kontext-Engineering verbessert die Customer Experience drastisch, weil KI-Systeme dadurch nicht nur verstehen, was ein Nutzer fragt, sondern auch, wer er ist, wo er sich in seiner Journey befindet und was er tatsächlich braucht. So macht es den Unterschied:

- Personalisierung in großem Maßstab: Indem relevanter Nutzungsverlauf, Präferenzen und Verhaltenssignale ins Kontextfenster der KI einfließen, wirken Antworten maßgeschneidert statt generisch.

- Weniger Reibung: Kunden müssen sich nicht wiederholen. Ein gut konstruiertes Kontextsystem trägt frühere Interaktionen, Kontodetails und den Sitzungszustand nahtlos über Touchpoints hinweg.

- Schnellere Problemlösung: Agenten und Chatbots mit reichhaltigem Kontext können Probleme in weniger Turns diagnostizieren und Lösungen vorschlagen – das senkt Bearbeitungszeit und Frust.

- Proaktive Unterstützung: Kontextbewusste Systeme können Bedürfnisse antizipieren – etwa indem sie eine Abrechnungs-FAQ einblenden, wenn ein Nutzer in den Zahlungsbereich navigiert, noch bevor er fragt. Wenn du tiefer in praktische Beispiele einsteigen möchtest, besuche den Blogpost von Amit Eyal Govrin von Kubiya.ai

- Konsistente Omnichannel-Experience: Ob ein Kunde per Chat, E-Mail oder Voice Kontakt aufnimmt – Kontext-Engineering sorgt für Kontinuität und Kohärenz über alle Kanäle.

- Mehr Vertrauen und Zufriedenheit: Wenn KI-Antworten relevant, korrekt und rechtzeitig sind, fühlen sich Kunden gesehen und wertgeschätzt – das steigert direkt CSAT- und NPS-Werte.

Bei digitalen Services entscheidet oft die Qualität der Erfassung, Pflege und Nutzung von Kontext darüber, ob das Erlebnis frustrierend oder begeisternd ist.

3. Was ist Kontext-Engineering in der Künstlichen Intelligenz?

Kontext-Engineering ist die Disziplin, die Informationen für ein KI-Modell – insbesondere ein Large Language Model (LLM) – bewusst zu gestalten, zu strukturieren und zu steuern, um Qualität, Relevanz und Genauigkeit der Ausgaben zu maximieren.

Kontext-Engineering ist das, wozu Prompt-Engineering wird, wenn du den Schritt machst von:

Experimentieren → Bereitstellen

Einer Person → Einem ganzen Team

Einem einzelnen Chat → Einem produktiven Business-System

4. Wie setze ich Kontext-Engineering in der Chatbot-Entwicklung um?

- Definiere deine Kontextschichten: Identifiziere, welche Kontexte dein Chatbot benötigt: Nutzungs- und Profildaten, Gesprächsverlauf, Geschäftsregeln, Echtzeitinformationen und abgerufenes Wissen.

- Designe eine System-Prompt-Architektur: Erstelle einen robusten System-Prompt, der Rolle, Tonalität, Einschränkungen und zentrale Instruktionen des Chatbots definiert. Das ist das Fundament deines Kontexts.

- Implementiere Konversationsgedächtnis: Nutze Kurzzeitgedächtnis, um den Fluss eines einzelnen Gesprächs zu halten, und Langzeitgedächtnis (in einer Datenbank gespeichert), um künftige Interaktionen auf Basis vergangener Sitzungen zu personalisieren.

- Integriere dynamisches Data Retrieval (RAG): Verbinde deinen Chatbot mit internen Wissensbasen, Produktkatalogen oder Dokumentationen, damit er bei Bedarf akkuraten Echtzeit-Kontext ziehen kann.

- Wende Kontextkompression und -zusammenfassung an: Wenn Gespräche lang werden, fasse frühere Turns zusammen, um das Kontextfenster für die relevantesten aktuellen Informationen freizuhalten.

- Verwende strukturierte Kontextinjektion: Formatiere Nutzermetadaten, Sitzungsvariablen und abgerufene Inhalte konsistent und parsebar, damit das Modell sie leicht extrahieren und nutzen kann.

- Teste auf Kontextfehler: Identifiziere Randfälle, in denen fehlender oder widersprüchlicher Kontext zu schlechten Antworten führt, und baue Fallback-Mechanismen ein.

Beobachte und iteriere: Protokolliere, welcher Kontext für jede Interaktion bereitgestellt wurde, und korreliere ihn mit Signalen zur Nutzerzufriedenheit, um deine Kontextstrategie im Zeitverlauf zu verfeinern.

Wirksames Kontext-Engineering verwandelt einen generischen Chatbot in einen wirklich intelligenten Assistenten, der für jeden Nutzer aufmerksam, reaktionsschnell und vertrauenswürdig wirkt.

Abschließende Gedanken

Wenn du KI-Assistenten baust, hör auf, wie ein Prompt-Schreiber zu denken, und fang an, wie ein Kontext-Ingenieur zu denken.

Dein System braucht nicht mehr Tokens, sondern intelligenteren Kontext.

Beginne damit, Kontext-Engineering zu entwerfen, das dafür sorgt, dass dein KI‑Assistent Ihre Welt wirklich versteht.