TL;DR

Se você já implantou um chatbot de IA e percebeu que os custos reais ficaram acima da estimativa, você já sabe algo importante: o uso de IA é mais dinâmico do que qualquer calculadora consegue captar de antemão. Isso não é um problema, é apenas a natureza de conversas reais. Entender por que os custos variam é o primeiro passo para realmente controlá-los.

“A coisa mais cara em IA não é o modelo. São os tokens que você nem percebeu que estava enviando.”

G.H.

1. O que os estimadores acertam (e seus limites)

Calculadoras de custo perguntam: mensagens diárias e modelo de IA. Elas multiplicam um custo fixo por mensagem pelo volume.

Exemplo:

100 mensagens/dia × 30 dias × $0,0025/mensagem ≈ $7,50/mês

Essa é uma base inteligente e uma ótima forma de comparar modelos ou estimar o ROI antes de entrar no ar. O que ela não consegue prever de antemão é como suas conversas reais vão se comportar: quanto tempo vão durar, quais recursos estarão ativos ou se haverá picos de tráfego. Isso não é uma falha da calculadora. É simplesmente a diferença entre uma estimativa e um ambiente ao vivo.

2. Como o contexto impulsiona os custos

A IA não lê apenas sua última mensagem. Ela lê tudo, sempre.

Cada resposta inclui:

- Prompt do sistema (instruções)

- Conteúdo da base de conhecimento / FAQ

- Histórico completo da conversa

- Nova mensagem do usuário

Essa janela de contexto cresce rápido. A mensagem 1 custa pouco. A mensagem 30 custa 30–50x mais, já que todo o histórico é reenviado.

Exemplo real: Uma resposta usou 22.696 tokens de entrada (vs. 564 de saída). A estimativa assumia ~500 de entrada. Realidade: 45x maior.

Modelo mental: Adicionar uma página a um documento, mas reimprimir o documento inteiro a cada vez.

3. Cinco principais fatores de custo

- Histórico da conversa, enviado toda vez. Conversas com 30 mensagens custam 100x+ em relação a interações únicas.

- Prompts do sistema (instruções), sempre incluídos. 3.000 tokens inflados vs. 300 enxutos = diferença de 10x por chamada.

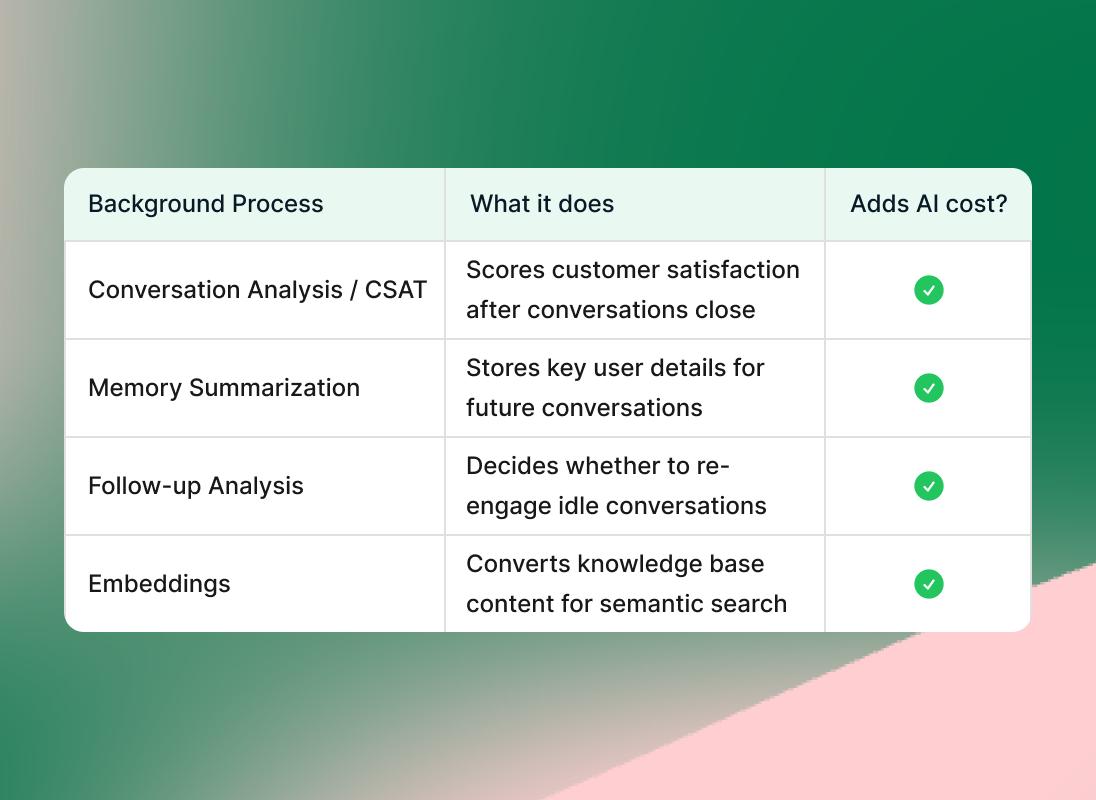

- Processos em segundo plano, CSAT, sumarização de memória, follow-ups, embeddings. Muitas vezes 3–5 chamadas de IA por mensagem.

- Mensagens com mídia, áudios, PDFs e imagens consomem milhares de tokens cada.

- Picos de tráfego e campanhas virais criam dias com volume 10x maior que a estimativa não conseguiria prever.

Processos em segundo plano somam: Plataformas modernas de assistente de IA executam várias tarefas nos bastidores, como análise de conversas, follow-up e sumarização de memória, e cada uma delas contribui para seus custos de IA.

4. Princípios de engenharia de contexto

Modelos mais baratos ajudam. Mas engenharia de contexto, ou seja, moldar deliberadamente o que entra na janela de contexto, traz os maiores ganhos. Tokens de entrada dominam os custos, e a entrada está sob seu controle.

Pilar 1: Prompts de sistema enxutos enviados em toda chamada, para sempre.

- Defina o papel em 2–3 frases (não 20)

- Use tópicos, não parágrafos

- Corte duplicações (“seja sempre educado” uma vez é suficiente)

- Elimine casos extremos raros

Meta: <500 tokens para simples; <1.500 para complexos

Pilar 2: Recuperação Inteligente de Conhecimento (RAG)

Colocar o FAQ inteiro em toda chamada é a abordagem ingênua. RAG recupera apenas as seções relevantes para cada pergunta específica.

Como isso funciona:

- O usuário faz uma pergunta

- O sistema busca no FAQ (ou base de conhecimento) os trechos mais relevantes

- Somente essas seções específicas e relevantes são enviadas para a IA

- A IA responde usando apenas o que precisa

Este é um exemplo de como você pode colocar as instruções:

[INSTRUÇÕES]

Você é um assistente de condomínio prestativo. Use as informações abaixo para responder.

Conhecimento relevante:

- Horário da piscina: segunda–domingo, 8:00 – 22:00.

- A piscina fecha em feriados e dias de manutenção.

Pergunta do morador: "Qual é o horário da piscina?"

Pilar 3: Gestão do histórico da conversa

- Janela deslizante: apenas as últimas 8–10 mensagens

- Sumarização: comprima o histórico antigo em fatos-chave

- Memória seletiva: mantenha apenas o contexto significativo

- Reinício de sessão: novo começo após a resolução

5. Seu checklist de ações

- Audite o prompt do sistema e corte-o pela metade. Teste a qualidade. Você normalmente vai se surpreender.

- Recupere, não injete. Use busca semântica apenas para o conhecimento relevante.

- Limite o histórico; as últimas 8–10 interações quase sempre são suficientes.

- Desative recursos não usados. Desligue CSAT/memória se você não estiver agindo sobre esses dados.

- Combine o modelo à tarefa. Barato/rápido para Q&A; premium apenas para raciocínio.

- Projete para menos interações. Respostas rápidas e fluxos estruturados reduzem interações e custo.

- Controle mídia: habilite processamento de voz/imagem/documentos apenas quando necessário.

- Monitore por evento. Acompanhe semanalmente tokens vs. processos em segundo plano vs. mídia.

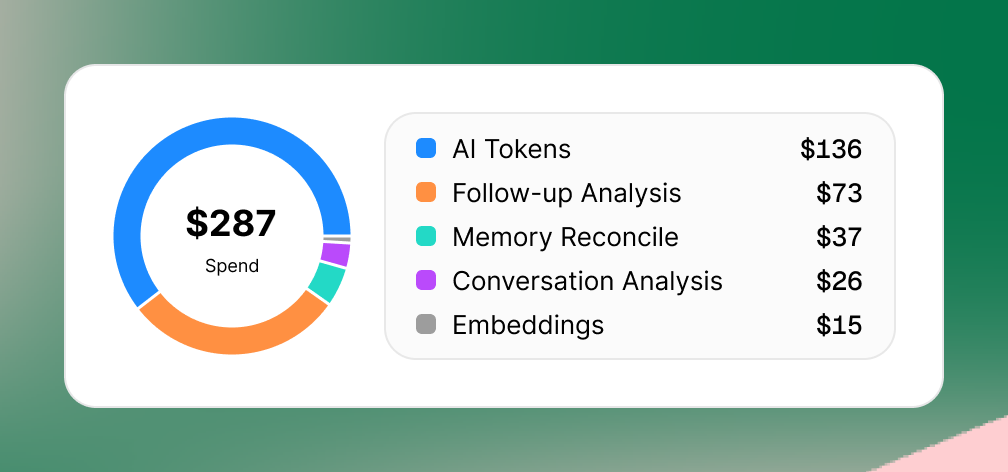

Widget de dashboard mostrando um gasto de $287 em IA visualizado por um gráfico de rosca colorido. Uma legenda detalha as categorias de custo de IA: Tokens de IA ($136, azul), Análise de Follow-up ($73, laranja), Reconciliação de Memória ($37, azul-petróleo), Análise de Conversa ($26, roxo) e Embeddings ($15, cinza), sobre um fundo com gradiente verde e rosa.

Perguntas frequentes

1. Como reduzir o uso de tokens no meu chatbot de IA sem prejudicar a qualidade das respostas?

Escolher o modelo de IA certo para cada tarefa traz os maiores ganhos. Modelos premium se destacam em raciocínio complexo, análises em várias etapas ou conversas sensíveis, mas modelos mais rápidos e baratos lidam tão bem quanto com Q&A direto. Essa única mudança costuma reduzir os custos em 3x imediatamente.

2. O que é engenharia de contexto para chatbots de IA e por que isso importa?

Engenharia de contexto significa controlar intencionalmente o que entra na janela de contexto da IA em cada mensagem: prompt do sistema + base de conhecimento + histórico da conversa. Esses três elementos respondem por 90%+ dos custos de tokens de entrada — que estão totalmente sob seu controle. Enxugar prompts e limitar o histórico gera economias de 5x–20x por decisões de design que qualquer pessoa pode implementar hoje.

3. Quanto a engenharia de contexto pode reduzir os custos de um chatbot de IA?

Equipes que aplicam engenharia de contexto, prompts de sistema mais enxutos, recuperação de conhecimento com RAG e limites no histórico da conversa costumam alcançar reduções de custo de 5x–20x sem trocar modelos de IA nem sacrificar a qualidade das respostas. Prompts do sistema e gestão do histórico compõem economias em cada mensagem, tornando essa a otimização de maior alavancagem para agências e desenvolvedores.

4. Devo desativar a pontuação de CSAT e os recursos de memória para economizar custos de IA?

Desative apenas os processos de IA em segundo plano que você não esteja usando ativamente.

5. Qual é a maneira mais rápida de reduzir agora os custos de tokens do chatbot de IA?

Audite e enxugue seu prompt do sistema. Esse único texto é enviado em toda chamada de IA, para sempre, em todas as conversas. Corte instruções prolixas, remova duplicações, use tópicos em vez de parágrafos e teste a versão mais curta. Você verá economias em poucas horas, muitas vezes com mais clareza.

6. Os custos de chatbots de IA vão ficar mais baratos automaticamente à medida que os modelos melhoram?

Sim, mas entender a mecânica dos tokens dá a você uma vantagem duradoura. Os modelos ficam mais eficientes a cada ano, as plataformas adicionam otimização automática de contexto e os preços caem de forma constante. Quem domina engenharia de contexto + seleção de modelos sempre superará quem depende apenas de melhorias dos fornecedores, independentemente da plataforma.

O novo modelo mental

Estimativas dão direção com base em médias — e isso é realmente útil. Conversas reais são mais longas, ricas e com recursos em segundo plano ativos. Quando você entende os motores: tamanho do contexto, processos em segundo plano e picos de tráfego, você passa a ter alavancas reais para acionar. Só a engenharia de contexto pode reduzir custos em 5x–20x, sem precisar trocar de modelo.

“A coisa mais cara em IA não é o modelo. São os tokens que você nem percebeu que estava enviando.”

Agências e desenvolvedores que dominam isso constroem sistemas mais enxutos, explicam custos com confiança aos clientes e escalam de forma previsível.

Comece a construir de forma mais inteligente, experimente o Invent gratuitamente hoje.