TL;DR

Da Invent, gestiamo follow‑up automatici basati su AI su WhatsApp per coinvolgere i clienti fuori orario, nei weekend e durante le festività. Quando i clienti non sono disponibili, la nostra AI individua il momento ottimale per riattivarli, mantenendo le conversazioni fluide e chiudendo le trattative senza intervento manuale.

Ma far operare l’AI a questo livello di autonomia solleva una domanda cruciale: come facciamo davvero a sapere che sta funzionando come previsto?

È qui che l’osservabilità dell’AI entra in gioco, ed è fondamentalmente diversa da ciò che la maggior parte dei team si aspetta.

Osservabilità dell’AI = la capacità di tracciare, riprodurre e valutare ogni decisione dell’AI in produzione, dal prompt e dall’uso degli strumenti fino ai passaggi di consegna e ai risultati.

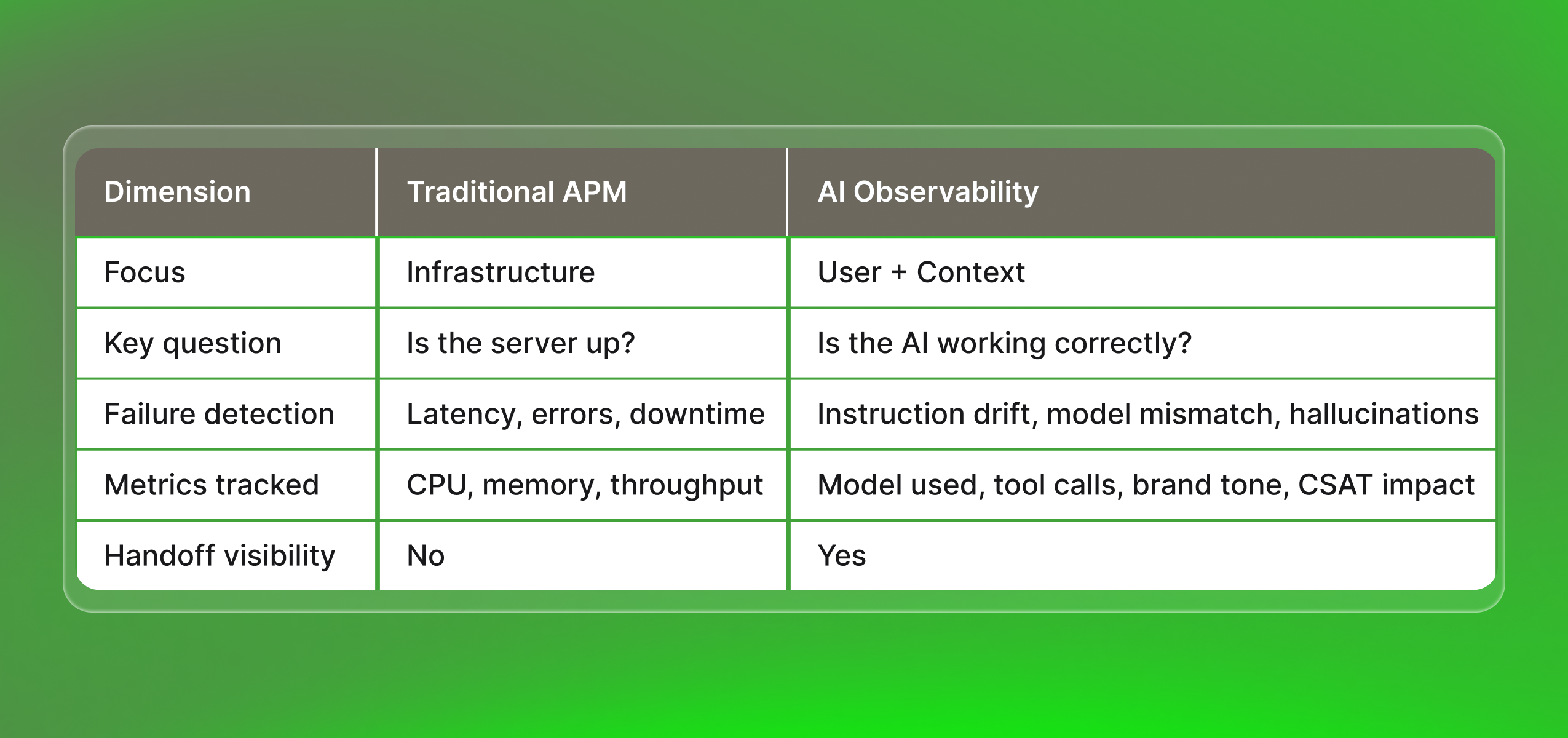

Perché l’APM tradizionale non basta per l’AI

L’Application Performance Monitoring (APM) monitora lo stato dell’infrastruttura: latenza, errori, throughput e utilizzo delle risorse tra servizi e database. Ci dice se il sistema sta funzionando.

L’osservabilità dell’AI pone domande più profonde:

- L’assistente sta seguendo le sue istruzioni di sistema?

- Mantiene il tono del brand su WhatsApp, web, SMS ed email?

- Sta usando correttamente gli strumenti (Stripe, Odoo, CRM, calendario, ricerca)?

- Rimane allineata a ciò che l’utente sta realmente cercando di ottenere?

È intrinsecamente incentrata su utente e contesto. Ci interessa se l’AI:

- Ha indirizzato correttamente un lead

- Ha risolto un ticket di supporto

- Ha rispettato le regole di memoria e privacy

- Ha coordinato un passaggio di consegna fluido a un umano

Tutto questo può fallire silenziosamente, anche quando ogni metrica d’infrastruttura è verde.

In configurazioni multi-modello e agentiche (GPT, Claude, Gemini, Grok + strumenti live), l’osservabilità deve anche rilevare:

- Quale modello è stato selezionato

- Quali strumenti sono stati eseguiti

- Come queste scelte hanno influito su costo, qualità e CSAT

Dall’infrastruttura all’intelligenza: scopri come l’osservabilità dell’AI ridefinisce il monitoraggio, concentrandosi su contesto utente, comportamento del modello e risultati reali fino al passaggio di consegna.

I modi più comuni in cui i sistemi di AI falliscono

Il problema più frequente che incontriamo non è l’allucinazione né il downtime, è il mismatch modello‑task. I team senza ampia esperienza cross-modello spesso tendono a scegliere le opzioni più familiari, e i risultati possono essere sottili ma costosi.

Grok 4.1 ha fatto trapelare il ragionamento interno

Grok 4.1 ha mostrato direttamente agli utenti finali i propri passaggi di ragionamento interni. Non era un’allucinazione: era un mismatch comportamentale tra i default del modello e i requisiti del prodotto. Senza osservabilità, quel problema si nasconde in piena vista.

Gemini Flash 2.5 allucina in presenza di lacune di conoscenza

Gemini Flash 2.5 tende ad allucinare quando le informazioni necessarie non sono nella sua base di conoscenza (istruzioni o system prompt). Quando manca il contesto, il modello colma il vuoto. La soluzione non è sempre cambiare modello: spesso è arricchire l’architettura della conoscenza.

Le allucinazioni possono dipendere da una carenza di conoscenza o da un problema di modello.

Scegliere la dimensione giusta del modello

- Modelli piccoli (versioni Nano, Lite e Mini): efficienti per task in stile FAQ senza escalation.

- Modelli grandi (Opus, Sonnet, Gemini Pro e serie Flash, serie GPT): necessari per ragionamenti complessi e multi-step.

L’osservabilità ci dice nel tempo se la calibrazione del modello sta davvero tenendo.

Il vero test: riesci a riprodurre un percorso AI fallito?

Quando valutiamo piattaforme di osservabilità per LLM, pipeline RAG o sistemi basati su agenti, usiamo un solo benchmark:

Possiamo riprodurre integralmente un percorso AI fallito?

Esempio pratico: Su un chatbot RAG alimentato dal tuo sito web e da Stripe, un percorso di pagamento fallito dovrebbe essere ricostruibile end-to-end:

- Messaggi esatti dell’utente

- Quali pagine sono state recuperate

- Quali chiamate API di Stripe sono partite

- Come il modello ha interpretato l’errore

- Come si è svolto il passaggio di consegna a un umano nella casella di posta

Se la tua strumentazione non può fornire tutto questo, hai dei log, non l’osservabilità.

Da Invent, abbiamo costruito l’osservabilità per canale e l’abbiamo estesa a ogni punto di integrazione. Avere riproducibilità e continuità del contesto lungo l’intero percorso assistito dall’AI è cruciale.

Cosa succede quando voli alla cieca

Abbiamo visto lo stesso schema ripetersi negli ambienti dei clienti: strumenti frammentati, visibilità limitata, comportamento dell’AI da scatola nera. In tutti i casi, i malfunzionamenti erano misurabili e prevenibili.

Lo scenario più dannoso? Scarsa visibilità nei passaggi di consegna AI-to-human. Quando nessuno può vedere esattamente dove l’AI si è fermata e dove un umano avrebbe dovuto intervenire:

- Le transizioni diventano goffe

- I ticket vanno persi

- I punteggi CSAT calano

Il percorso si interrompe, ma poiché nessuno strumento cattura l’intero quadro, la diagnosi non avviene mai.

Non è un errore tecnico. È un errore di osservabilità.

UX e sviluppo prodotto devono essere integrati. L’osservabilità lo rende reale.

Checklist di prontezza per la produzione

Prima di distribuire l’AI in produzione, consigliamo di porsi queste 7 domande:

- Possiamo riprodurre end-to-end qualsiasi percorso AI fallito?

- Sappiamo quale modello è stato usato per ogni decisione?

- Possiamo tracciare ogni chiamata di strumento (CRM, pagamenti, calendario, ricerca)?

- La coerenza del tono del brand è monitorata su tutti i canali?

- I passaggi di consegna AI-to-human sono visibili e auditabili?

- Abbiamo alert in tempo reale per drift delle istruzioni o allucinazioni?

- Possiamo correlare il comportamento dell’AI con CSAT, conversioni e costo?

Se hai risposto “no” a una di queste, non sei pronto per la produzione.

FAQ

1. Come dovrebbero scegliere le aziende gli strumenti di osservabilità per l’AI?

Dai priorità a compliance (SOC2, audit trail), scalabilità (miliardi di tracce), copertura ibrida (ML + LLM + agenti), e compatibilità con l’ecosistema.

2. Modelli di pricing per i servizi di osservabilità dell’AI più diffusi?

- A consumo: Per traccia/previsione/token (Phoenix, LangSmith)

- Basato su host/entità: Per unità di infrastruttura (Datadog, New Relic)

- Utenti + consumo: Per utente + volume di dati

- Enterprise: Contratti personalizzati con tetti

3. Piattaforme di osservabilità AI per l’enterprise?

Cloudflare AI Gateway (osservabilità dei prompt), Arize Phoenix (drift), LangSmith (debugging LLM).

Costruire una cultura attorno all’osservabilità

Otteniamo i risultati migliori combinando una profonda competenza tecnica con trasparenza radicale e collaborazione async. Rendere abituali PR tra fusi orari e condivisione aperta del contesto ci ha permesso di accelerare il rilascio, aumentare l’agilità del team, e questo slancio si mantiene solo quando l’osservabilità è incorporata come capacità centrale del prodotto.

Da Invent, condividiamo insight maturati costruendo piattaforme di customer engagement basate su AI che operano in modo affidabile su WhatsApp, web, SMS ed email. Scopri di più su useinvent.com.