TL;DR

Chez Invent, nous assurons des relances automatisées pilotées par l’IA sur WhatsApp pour engager les clients en dehors des heures ouvrées, le week‑end et pendant les jours fériés. Lorsque les clients sont indisponibles, notre IA identifie le moment optimal pour relancer, afin de faire avancer les conversations et conclure des ventes sans intervention manuelle.

Mais faire fonctionner l’IA avec un tel niveau d’autonomie pose une question critique : comment savoir concrètement qu’elle fonctionne comme prévu ?

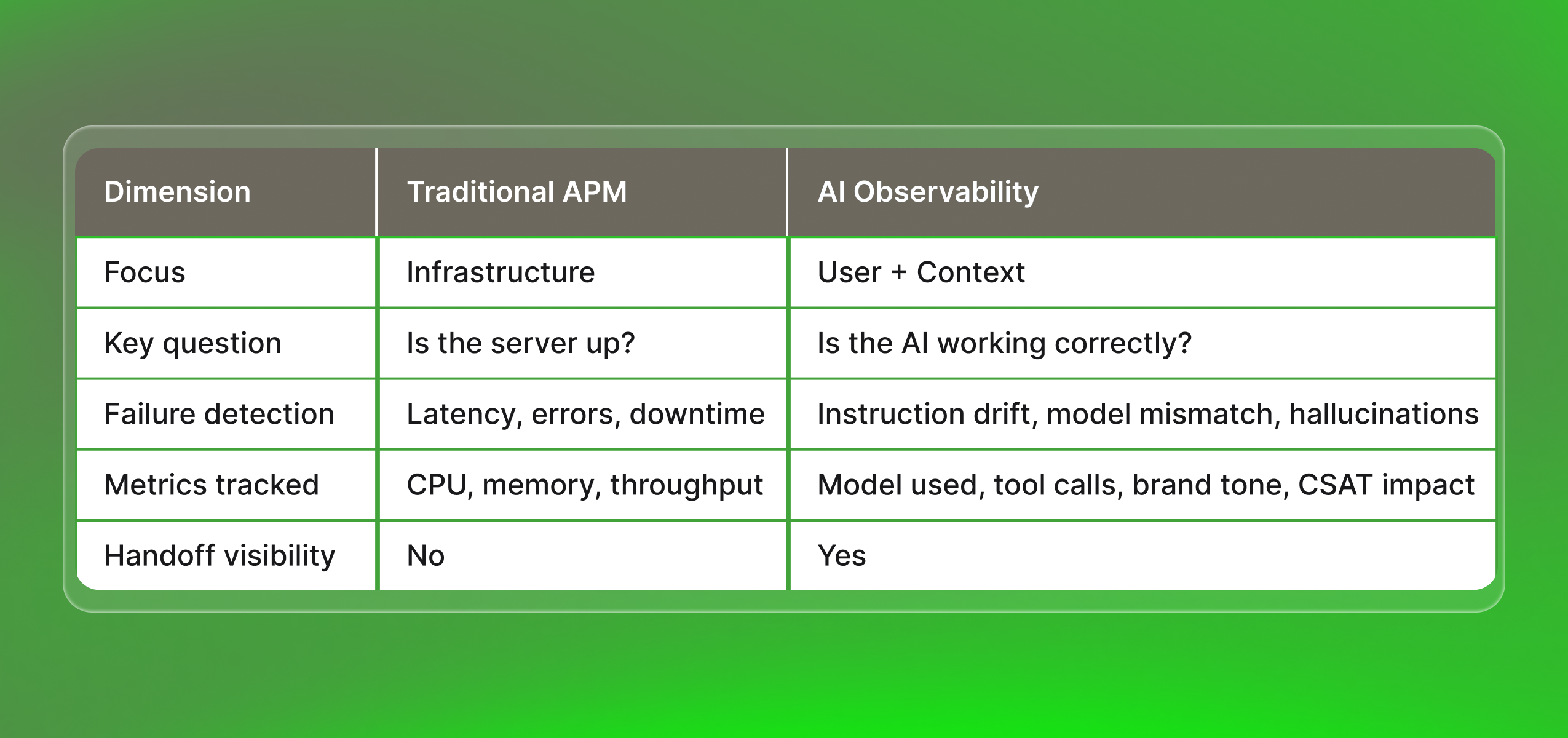

C’est là que l’observabilité de l’IA entre en jeu, et elle est fondamentalement différente de ce à quoi la plupart des équipes s’attendent.

Observabilité de l’IA = la capacité à tracer, rejouer et évaluer chaque décision prise par l’IA en production, depuis le prompt et l’utilisation des outils jusqu’aux passages de relais et aux résultats.

Pourquoi l’APM traditionnel ne suffit pas pour l’IA

La supervision traditionnelle des performances applicatives (APM) suit l’état de santé de l’infrastructure : latence, erreurs, débit et utilisation des ressources à travers services et bases de données. Elle nous dit si le système est opérationnel.

L’observabilité de l’IA pose un ensemble de questions plus profondes :

- L’assistant suit‑il ses instructions système ?

- Maintient‑il le ton de marque sur WhatsApp, le web, SMS et email ?

- Utilise‑t‑il correctement les outils (Stripe, Odoo, CRM, calendrier, recherche) ?

- Reste‑t‑il aligné avec ce que l’utilisateur cherche réellement à accomplir ?

Elle est intrinsèquement centrée sur l’utilisateur et le contexte. Ce qui nous importe, c’est de savoir si l’IA :

- A correctement routé un lead

- A résolu un ticket de support

- A respecté les règles de mémoire et de confidentialité

- A coordonné un passage de relais fluide vers un humain

Tout cela peut échouer silencieusement, même lorsque chaque métrique d’infrastructure est au vert.

Dans des configurations multi‑modèles, orientées agents (GPT, Claude, Gemini, Grok + outils en temps réel), l’observabilité doit aussi capturer :

- Quel modèle a été sélectionné

- Quels outils ont été exécutés

- Comment ces choix ont impacté le coût, la qualité et le CSAT

De l’infrastructure à l’intelligence : découvrez comment l’Observabilité de l’IA redéfinit le monitoring en se focalisant sur le contexte utilisateur, le comportement du modèle et les résultats réels jusqu’au passage de relais.

Les modes de défaillance les plus courants des systèmes d’IA

La défaillance la plus fréquente que nous rencontrons n’est ni l’hallucination ni l’indisponibilité, c’est l’inadéquation modèle‑tâche. Les équipes sans large expérience inter‑modèles optent souvent pour des choix familiers, avec des effets subtils mais coûteux.

Grok 4.1 a divulgué son raisonnement interne

Grok 4.1 a exposé ses étapes de raisonnement internes directement aux utilisateurs finaux. Ce n’était pas une hallucination, mais un décalage comportemental entre les valeurs par défaut du modèle et les exigences du produit. Sans observabilité, cet échec passe inaperçu.

Gemini Flash 2.5 hallucine en cas de lacunes de connaissances

Gemini Flash 2.5 a tendance à halluciner lorsque l’information nécessaire n’est pas dans sa base de connaissances (instructions ou prompt système). Quand le contexte manque, le modèle comble le vide. La solution n’est pas toujours de changer de modèle, mais d’enrichir l’architecture des connaissances.

Les hallucinations peuvent venir d’un manque de connaissances ou d’un problème de modèle.

Choisir la bonne taille de modèle

- Petits modèles (versions Nano, Lite et Mini) : Efficaces pour des tâches de type FAQ sans escalade.

- Grands modèles (Opus, Sonnet, Gemini Pro et séries Flash, séries GPT) : Indispensables pour un raisonnement complexe en plusieurs étapes.

L’observabilité nous indique, dans la durée, si le calibrage du modèle tient réellement.

Le vrai test : pouvez‑vous rejouer un parcours IA en échec ?

Lors de l’évaluation de plateformes d’observabilité pour des LLMs, des pipelines RAG ou des systèmes à base d’agents, nous utilisons un seul critère de référence :

Pouvons‑nous rejouer intégralement un parcours IA en échec ?

Exemple pratique : Sur un chatbot RAG adossé à votre site web et à Stripe, un parcours de paiement échoué doit pouvoir être reconstruit de bout en bout :

- Messages exacts de l’utilisateur

- Quelles pages ont été récupérées

- Quels appels à l’API Stripe ont été déclenchés

- Comment le modèle a interprété l’erreur

- Comment le passage de relais vers un humain s’est déroulé dans la boîte de réception

Si votre outillage ne fournit pas cela, vous avez des logs, pas de l’observabilité.

Chez Invent, nous avons conçu l’observabilité par canal et l’avons étendue à chaque point d’intégration. Disposer de la rejouabilité et de la continuité de contexte sur tout le parcours assisté par l’IA est essentiel.

Que se passe‑t‑il quand vous opérez à l’aveugle

Nous avons vu le même schéma se répéter chez nos clients : outils fragmentés, visibilité limitée, comportements d’IA opaques. Dans chaque cas, les défaillances étaient mesurables et évitables.

Le scénario le plus dommageable ? Une faible visibilité sur les passages de relais IA‑vers‑humain. Quand personne ne voit précisément où l’IA s’est arrêtée et où un humain aurait dû intervenir :

- Les transitions deviennent maladroites

- Des tickets se perdent

- Les scores CSAT chutent

Le parcours se brise, mais comme aucun outil ne saisit la vue d’ensemble, le diagnostic n’a jamais lieu.

Ce n’est pas une défaillance technique. C’est une défaillance d’observabilité.

L’UX et le développement produit doivent être intégrés. L’observabilité rend cela concret.

Liste de contrôle de préparation à la production

Avant de déployer l’IA en production, nous recommandons de poser ces 7 questions :

- Pouvons‑nous rejouer n’importe quel parcours IA en échec, de bout en bout ?

- Savons‑nous quel modèle a été utilisé pour chaque décision ?

- Pouvons‑nous tracer chaque appel d’outil (CRM, paiements, calendrier, recherche) ?

- La cohérence du ton de marque est‑elle surveillée sur tous les canaux ?

- Les passages de relais IA vers humain sont‑ils visibles et auditables ?

- Avons‑nous des alertes en temps réel en cas de dérive des instructions ou d’hallucinations ?

- Pouvons‑nous corréler le comportement de l’IA avec le CSAT, la conversion et le coût ?

Si vous avez répondu « non » à l’une d’elles, vous n’êtes pas prêt pour la production.

FAQ

1. Comment les entreprises devraient‑elles choisir des outils d’observabilité de l’IA ?

Priorisez la conformité (SOC2, pistes d’audit), l’échelle (milliards de traces), la couverture hybride (ML + LLMs + agents) et l’adéquation à l’écosystème.

2. Modèles de tarification des services d’observabilité de l’IA les plus populaires ?

- À l’usage: Par trace/prédiction/jeton (Phoenix, LangSmith)

- Basé sur l’hôte/l’entité: Par unité d’infrastructure (Datadog, New Relic)

- Licences + usage: Par utilisateur + volume de données

- Entreprise: Contrats sur mesure avec plafonds

3. Plateformes d’observabilité de l’IA pour les entreprises ?

Cloudflare AI Gateway (observabilité des prompts), Arize Phoenix (dérive), LangSmith (débogage LLM).

Construire une culture autour de l’observabilité

Nous obtenons nos meilleurs résultats en combinant une grande expertise technique avec une transparence radicale et une collaboration asynchrone. Faire des PR inter‑fuseaux horaires et instaurer le partage ouvert du contexte comme habitudes quotidiennes nous a permis d’accélérer les livraisons, d’accroître l’agilité de l’équipe, et cet élan ne se maintient que si l’observabilité est intégrée comme une capacité produit fondamentale.

Chez Invent, nous partageons des enseignements tirés de la construction de plateformes d’engagement client alimentées par l’IA, fiables sur WhatsApp, le web, SMS et email. En savoir plus sur useinvent.com.