Resumen rápido

En Invent, impulsamos seguimientos automáticos con AI en WhatsApp para interactuar con clientes fuera del horario laboral, los fines de semana y durante días festivos. Cuando los clientes no están disponibles, nuestra AI identifica el momento óptimo para retomar el contacto, manteniendo las conversaciones activas y los negocios avanzando sin intervención manual.

Pero operar AI con este nivel de autonomía plantea una pregunta crítica: ¿cómo sabemos realmente que está funcionando como se espera?

Ahí es donde entra la observabilidad de AI y es fundamentalmente distinta de lo que la mayoría de los equipos espera.

Observabilidad de AI = la capacidad de rastrear, reproducir y evaluar cada decisión de AI en producción, desde el prompt y el uso de herramientas hasta las transferencias y los resultados.

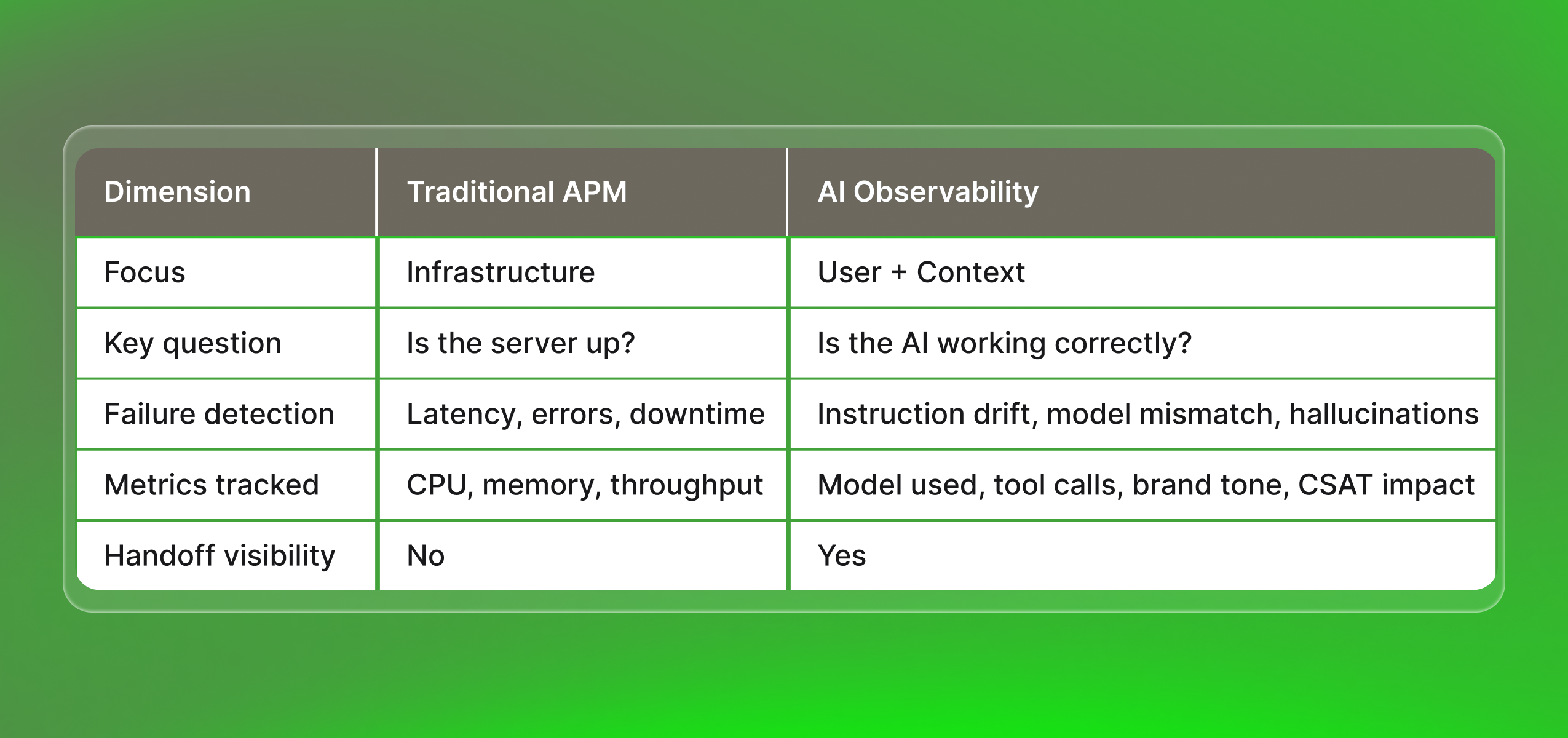

Por qué el APM tradicional no es suficiente para la AI

El Application Performance Monitoring (APM) tradicional rastrea el estado de la infraestructura: latencia, errores, rendimiento y uso de recursos en servicios y bases de datos. Nos dice si el sistema está funcionando.

La observabilidad de AI plantea un conjunto de preguntas más profundas:

- ¿El asistente está siguiendo sus instrucciones del sistema?

- ¿Mantiene el tono de marca en WhatsApp, web, SMS y correo electrónico?

- ¿Está usando correctamente las herramientas (Stripe, Odoo, CRM, calendario, búsqueda)?

- ¿Sigue alineado con lo que el usuario realmente intenta lograr?

Es inherentemente centrada en el usuario y el contexto. Nos importa si la AI:

- Enrutó correctamente un lead

- Resolvió un ticket de soporte

- Respetó las reglas de memoria y privacidad

- Coordinó una transferencia fluida a un humano

Todo esto puede fallar en silencio, incluso cuando todas las métricas de infraestructura se ven en verde.

En configuraciones multimodelo y agénticas (GPT, Claude, Gemini, Grok + herramientas en vivo), la observabilidad también debe capturar:

- Qué modelo se seleccionó

- Qué herramientas se ejecutaron

- Cómo esas decisiones afectaron el costo, la calidad y el CSAT

De la infraestructura a la inteligencia: mira cómo la observabilidad de AI redefine la monitorización, enfocándose en el contexto del usuario, el comportamiento del modelo y los resultados del mundo real hasta la transferencia.

Las formas más comunes en que fallan los sistemas de AI

El fallo más frecuente que encontramos no es la alucinación ni el tiempo de inactividad, sino el desajuste entre modelo y tarea. Los equipos sin experiencia amplia entre distintos modelos suelen optar por las opciones conocidas, y los resultados pueden ser sutiles pero costosos.

Grok 4.1 filtró razonamiento interno

Grok 4.1 mostró sus pasos de razonamiento interno directamente a los usuarios finales. No fue una alucinación, sino un desajuste de comportamiento entre los valores predeterminados del modelo y los requisitos del producto. Sin observabilidad, ese fallo se oculta a plena vista.

Gemini Flash 2.5 alucina ante vacíos de conocimiento

Gemini Flash 2.5 tiende a alucinar cuando la información necesaria no está en su base de conocimiento (instrucciones o system prompt). Cuando falta contexto, el modelo rellena el vacío. La solución no siempre es cambiar de modelo, sino enriquecer la arquitectura de conocimiento.

Las alucinaciones pueden deberse a falta de conocimiento o a un problema del modelo.

Elegir el tamaño de modelo adecuado

- Modelos pequeños (versiones Nano, Lite y Mini): eficientes para tareas tipo FAQ sin escalamiento.

- Modelos grandes (Opus, Sonnet, Gemini Pro y la serie Flash, serie GPT): necesarios para razonamiento complejo de múltiples pasos.

La observabilidad nos dice con el tiempo si la calibración del modelo realmente se mantiene.

La prueba real: ¿puedes reproducir un recorrido fallido de AI?

Al evaluar plataformas de observabilidad para LLMs, pipelines RAG o sistemas basados en agentes, usamos un criterio de referencia:

¿Podemos reproducir por completo un recorrido fallido de AI?

Ejemplo práctico: En un chatbot RAG respaldado por tu sitio web y Stripe, un recorrido de pago fallido debería poder reconstruirse de punta a punta:

- Mensajes exactos del usuario

- Qué páginas se recuperaron

- Qué llamadas a la API de Stripe se activaron

- Cómo interpretó el modelo el error

- Cómo se desarrolló la transferencia a un humano en la bandeja de entrada

Si tus herramientas no pueden ofrecer eso, tienes logs, no observabilidad.

En Invent, construimos observabilidad por canal y la extendimos a cada punto de integración. Contar con capacidad de reproducción y continuidad de contexto a lo largo de todo el recorrido asistido por AI es crucial.

Qué ocurre cuando vuelas a ciegas

Hemos visto el mismo patrón repetirse en entornos de clientes: herramientas fragmentadas, visibilidad limitada, comportamiento de AI de caja negra. En todos los casos, los fallos eran medibles y evitables.

¿El escenario más dañino? Mala visibilidad de las transferencias de AI a humanos. Cuando nadie puede ver exactamente dónde se detuvo la AI y dónde debería haber intervenido un humano:

- Las transiciones se vuelven torpes

- Los tickets se pierden

- Las puntuaciones de CSAT caen

El recorrido se rompe, pero como ninguna herramienta captura la imagen completa, nunca se llega al diagnóstico.

Eso no es un fallo técnico. Es un fallo de observabilidad.

La UX y el desarrollo de producto deben estar integrados. La observabilidad lo hace realidad.

Checklist de preparación para producción

Antes de desplegar AI en producción, recomendamos hacerse estas 7 preguntas:

- ¿Podemos reproducir de punta a punta cualquier recorrido fallido de AI?

- ¿Sabemos qué modelo se utilizó para cada decisión?

- ¿Podemos rastrear cada llamada a herramientas (CRM, pagos, calendario, búsqueda)?

- ¿Se monitoriza la consistencia del tono de marca en todos los canales?

- ¿Las transferencias de AI a humanos son visibles y auditables?

- ¿Tenemos alertas en tiempo real para deriva de instrucciones o alucinaciones?

- ¿Podemos correlacionar el comportamiento de AI con CSAT, conversión y costo?

Si respondiste "no" a cualquiera de estas, no estás listo para producción.

Preguntas frecuentes

1. ¿Cómo deberían las empresas elegir herramientas de observabilidad de AI?

Prioriza el cumplimiento (SOC2, trazas de auditoría), la escala (miles de millones de trazas), la cobertura híbrida (ML + LLMs + agentes) y el encaje con el ecosistema.

2. ¿Modelos de precios de los servicios populares de observabilidad de AI?

- Basado en uso: Por traza/predicción/token (Phoenix, LangSmith)

- Basado en host/entidad: Por unidad de infraestructura (Datadog, New Relic)

- Licencias + uso: Por usuario + volumen de datos

- Enterprise: Contratos personalizados con límites

3. ¿Plataformas de observabilidad de AI para empresas?

Cloudflare AI Gateway (observabilidad de prompts), Arize Phoenix (drift), LangSmith (debugging de LLM).

Crear una cultura en torno a la observabilidad

Impulsamos nuestros mejores resultados combinando una gran capacidad técnica con transparencia radical y colaboración asíncrona. Convertir en hábitos diarios las PRs entre distintas zonas horarias y el intercambio abierto de contexto nos ha permitido acelerar las entregas, aumentar la agilidad del equipo, y ese impulso solo se mantiene cuando la observabilidad está integrada como una capacidad central del producto.

En Invent, compartimos aprendizajes de la creación de plataformas de interacción con clientes impulsadas por AI que operan de forma fiable en WhatsApp, web, SMS y correo electrónico. Descubre más en useinvent.com.