TL;DR

Bei Invent, ermöglichen wir KI-gestützte automatische Follow-ups auf WhatsApp, um Kund:innen außerhalb der Geschäftszeiten, an Wochenenden und an Feiertagen zu erreichen. Wenn Kund:innen nicht verfügbar sind, ermittelt unsere KI den optimalen Zeitpunkt für die erneute Ansprache – so bleiben Gespräche im Fluss und Abschlüsse kommen zustande, ganz ohne manuelles Eingreifen.

Doch der Betrieb von KI mit diesem Maß an Autonomie wirft eine entscheidende Frage auf: Woher wissen wir eigentlich, dass sie wie beabsichtigt funktioniert?

Genau hier kommt AI-Observability ins Spiel – und sie unterscheidet sich grundlegend von dem, was die meisten Teams erwarten.

AI-Observability = die Fähigkeit, jede KI-Entscheidung in der Produktion nachzuverfolgen, zu reproduzieren und zu bewerten – vom Prompt und der Tool-Nutzung bis zu Übergaben und Ergebnissen.

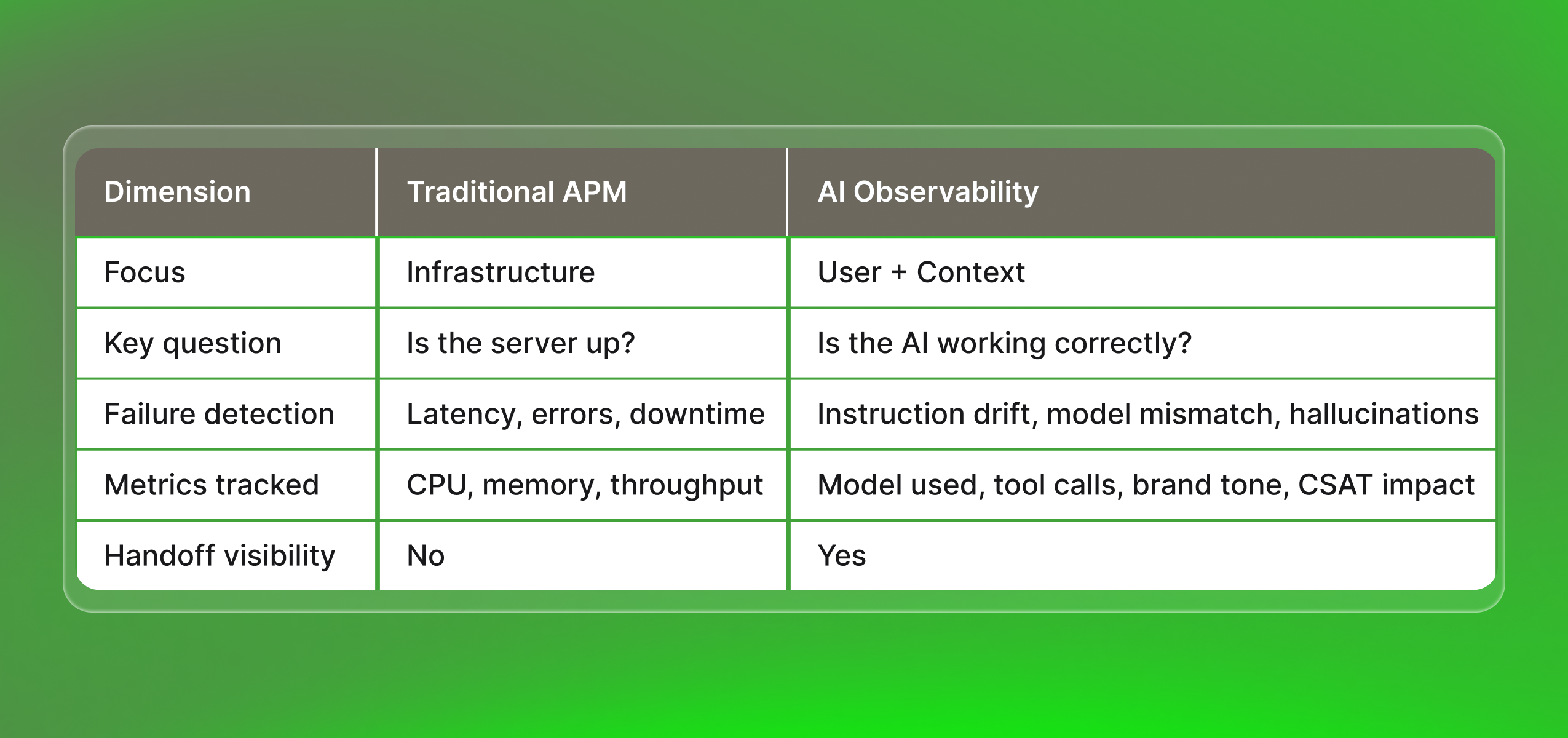

Warum klassisches APM für KI nicht ausreicht

Klassisches Application Performance Monitoring (APM) überwacht den Zustand der Infrastruktur: Latenz, Fehler, Durchsatz und Ressourcennutzung über Services und Datenbanken hinweg. Es sagt uns, ob das System läuft.

AI-Observability stellt tiefere Fragen:

- Folgt der Assistent seinen Systemanweisungen?

- Hält er den Markenton über WhatsApp, Web, SMS und E-Mail hinweg ein?

- Verwendet er die Tools (Stripe, Odoo, CRM, Kalender, Suche) korrekt?

- Bleibt er im Einklang mit dem, was die Nutzer:innen tatsächlich erreichen wollen?

Sie ist von Natur aus nutzer- und kontextzentriert. Uns interessiert, ob die KI:

- Einen Lead korrekt weitergeleitet hat

- Ein Support-Ticket gelöst hat

- Speicher- und Datenschutzregeln eingehalten hat

- Eine reibungslose Übergabe an einen Menschen koordiniert hat

All das kann unbemerkt fehlschlagen – selbst wenn alle Infrastrukturmetriken grün sind.

In Multi-Model- und agentenbasierten Setups (GPT, Claude, Gemini, Grok + Live-Tools) muss Observability zudem erfassen:

- Welches Modell ausgewählt wurde

- Welche Tools ausgeführt wurden

- Wie sich diese Entscheidungen auf Kosten, Qualität und CSAT ausgewirkt haben

Von Infrastruktur zu Intelligenz: Sehen Sie, wie AI-Observability Monitoring neu definiert – mit Fokus auf Nutzerkontext, Modellverhalten und reale Ergebnisse bis hin zur Übergabe.

Die häufigsten Ausfallarten von KI-Systemen

Der häufigste Fehler, dem wir begegnen, ist nicht Halluzination oder Ausfallzeit, sondern Mismatch zwischen Modell und Aufgabe. Teams ohne breite modellübergreifende Erfahrung greifen häufig zu vertrauten Optionen – die Folgen sind oft subtil, aber teuer.

Grok 4.1 gab interne Denkschritte preis

Grok 4.1 zeigte Endnutzer:innen seine internen Denkschritte direkt an. Das war keine Halluzination, sondern ein Verhaltens-Mismatch zwischen den Standardeinstellungen des Modells und den Anforderungen des Produkts. Ohne Observability verbirgt sich dieser Fehler im Offensichtlichen.

Gemini Flash 2.5 halluziniert bei Wissenslücken

Gemini Flash 2.5 neigt zu Halluzinationen, wenn benötigte Informationen nicht in seiner Wissensbasis (Instruktionen oder System-Prompt) enthalten sind. Fehlt Kontext, füllt das Modell die Lücke. Die Lösung ist nicht immer ein Modellwechsel, sondern oft die Anreicherung der Wissensarchitektur.

Halluzinationen können auf fehlendes Wissen oder ein Modellproblem zurückzuführen sein.

Die richtige Modellgröße wählen

- Kleine Modelle (Versionen Nano, Lite und Mini): Effizient für Aufgaben im FAQ-Stil ohne Eskalation.

- Große Modelle (Opus, Sonnet, Gemini Pro und die Flash- sowie GPT-Serien): Erforderlich für komplexes, mehrstufiges Reasoning.

Observability zeigt uns im Zeitverlauf, ob die Modellkalibrierung tatsächlich stabil bleibt.

Der eigentliche Test: Können Sie eine fehlgeschlagene KI-Journey reproduzieren?

Bei der Bewertung von Observability-Plattformen für LLMs, RAG-Pipelines oder agentenbasierte Systeme nutzen wir eine zentrale Benchmark:

Können wir eine fehlgeschlagene KI-Journey vollständig reproduzieren?

Praxisbeispiel: Bei einem RAG-Chatbot, der auf Ihrer Website und Stripe basiert, sollte sich eine fehlgeschlagene Payment-Journey Ende-zu-Ende rekonstruieren lassen:

- Exakte Nachrichten der Nutzer:innen

- Welche Seiten abgerufen wurden

- Welche Stripe-API-Calls ausgelöst wurden

- Wie das Modell den Fehler interpretiert hat

- Wie die Übergabe an den Menschen im Postfach ablief

Wenn Ihr Tooling das nicht leisten kann, haben Sie Logs – keine Observability.

Bei Invent haben wir Observability pro Kanal entwickelt und über jeden Integrationspunkt hinweg ausgedehnt. Reproduzierbarkeit und Kontextkontinuität über die gesamte KI-unterstützte Journey hinweg sicherzustellen, ist entscheidend.

Was passiert, wenn Sie im Blindflug unterwegs sind

Wir sehen dasselbe Muster immer wieder in Kundenumgebungen: fragmentierte Tools, begrenzte Sichtbarkeit, Blackbox-Verhalten der KI. In allen Fällen waren die Ausfälle messbar – und vermeidbar.

Das schädlichste Szenario? Geringe Sichtbarkeit bei KI-zu-Mensch-Übergaben. Wenn niemand genau sehen kann, wo die KI aufgehört hat und ein Mensch hätte übernehmen sollen:

- Übergänge werden holprig

- Tickets gehen verloren

- CSAT-Werte sinken

Die Journey bricht – doch weil kein einzelnes Tool das Gesamtbild erfasst, findet keine Diagnose statt.

Das ist kein technischer Fehler. Es ist ein Observability-Fehler.

UX und Produktentwicklung müssen integriert sein. Observability macht das möglich.

Checkliste für Produktionsreife

Bevor Sie KI in Produktion bringen, empfehlen wir diese 7 Fragen:

- Können wir jede fehlgeschlagene KI-Journey Ende-zu-Ende reproduzieren?

- Wissen wir, welches Modell für jede Entscheidung verwendet wurde?

- Können wir jeden Tool-Call (CRM, Payments, Kalender, Suche) nachverfolgen?

- Wird die Konsistenz des Markentons kanalübergreifend überwacht?

- Sind KI-zu-Mensch-Übergaben sichtbar und auditierbar?

- Haben wir Echtzeit-Warnungen bei Instruktionsdrift oder Halluzinationen?

- Können wir das KI-Verhalten mit CSAT, Conversion und Kosten korrelieren?

Wenn Sie eine dieser Fragen mit „Nein“ beantworten, sind Sie nicht produktionsreif.

FAQs

1. Wie sollten Unternehmen AI-Observability-Tools auswählen?

Priorisieren Sie Compliance (SOC2, Audit-Trails), Skalierung (Milliarden von Traces), hybride Abdeckung (ML + LLMs + Agents) und Ökosystem-Fit.

2. Preismodelle gängiger AI-Observability-Services?

- Nutzungsbasiert: Pro Trace/Prediction/Token (Phoenix, LangSmith)

- Host-/Entity-basiert: Pro Infrastruktureinheit (Datadog, New Relic)

- Seats + Nutzung: Pro User + Datenvolumen

- Enterprise: Individuelle Verträge mit Obergrenzen

3. AI-Observability-Plattformen für Unternehmen?

Cloudflare AI Gateway (Prompt-Observability), Arize Phoenix (Drift), LangSmith (LLM-Debugging).

Eine Kultur rund um Observability aufbauen

Unsere besten Ergebnisse erzielen wir, indem wir tiefes technisches Know-how mit radikaler Transparenz und asynchroner Zusammenarbeit verbinden. Cross-Timezone-PRs und offenes Teilen von Kontext als tägliche Gewohnheiten haben uns ermöglicht, schneller auszuliefern und die Team-Agilität zu steigern – und dieser Schwung hält nur an, wenn Observability als zentrale Produktfähigkeit verankert ist.

Bei Invent, teilen wir Einblicke aus dem Aufbau KI-gestützter Customer-Engagement-Plattformen, die zuverlässig über WhatsApp, Web, SMS und E-Mail operieren. Mehr erfahren unter useinvent.com.